下一个

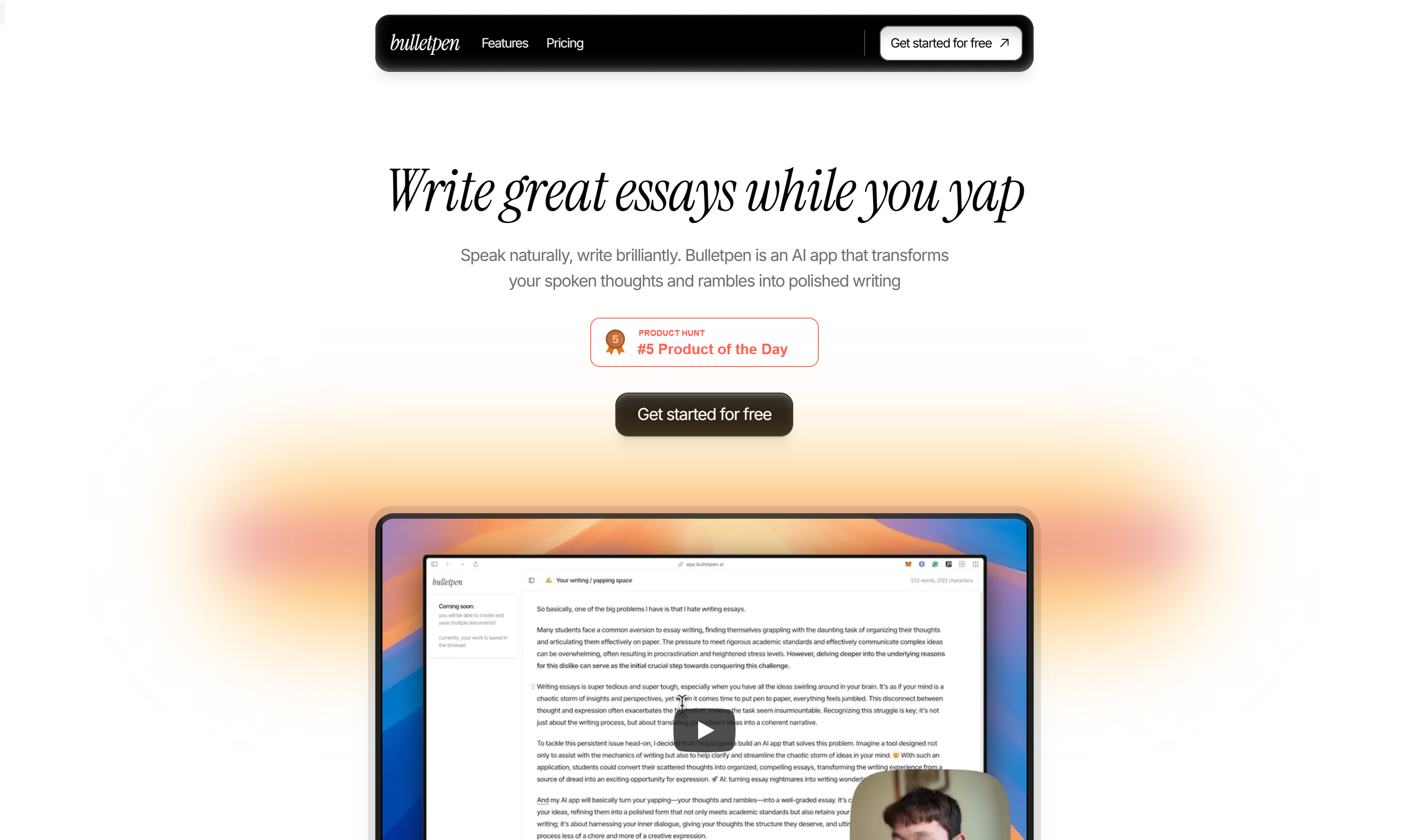

Bulletpen

相关AI工具集

-

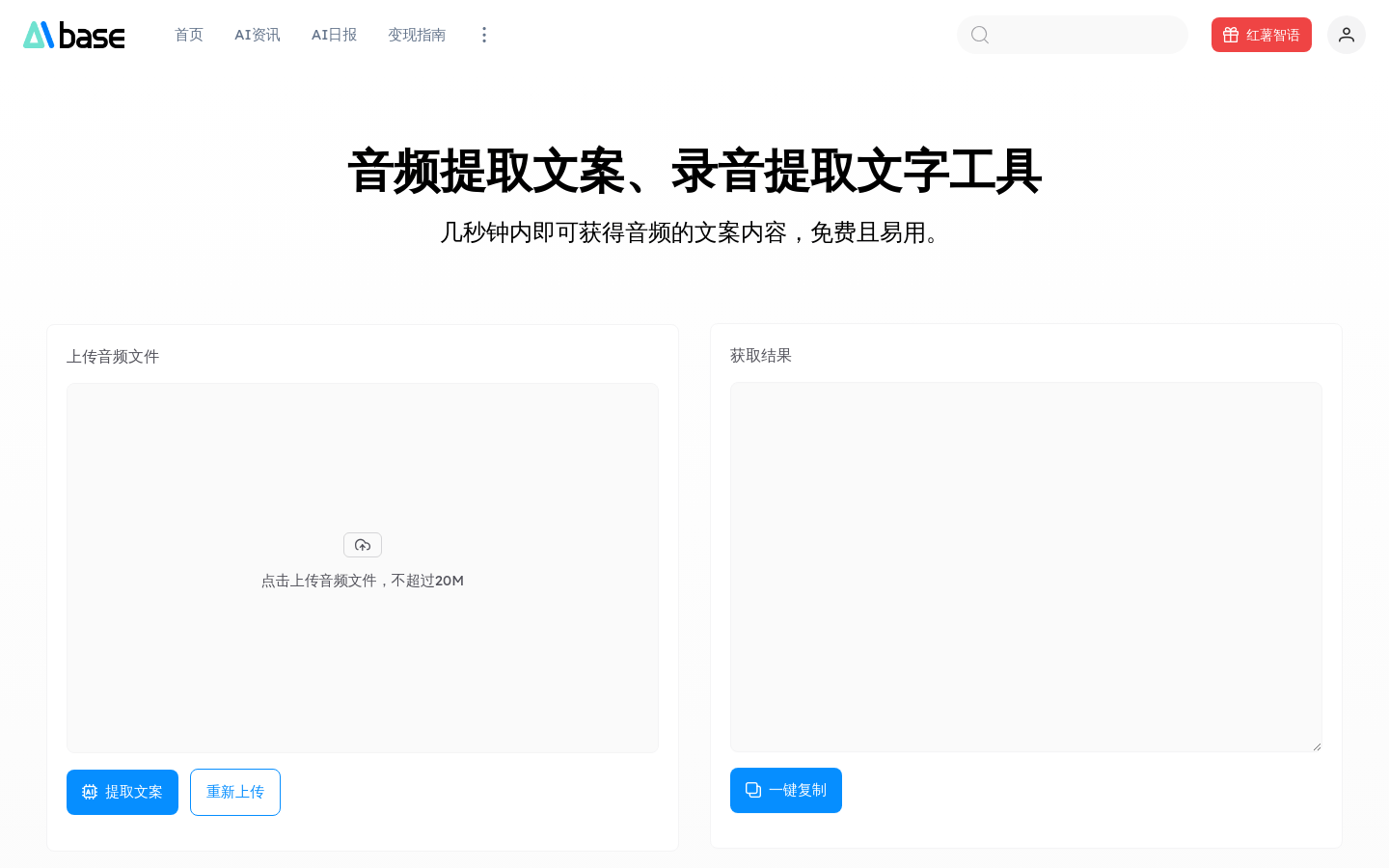

音频提取文字工具AIbase音频提取文字工具利用人工智能技术,通过机器学习模型快速生成高质量的音频文本描述,优化文本排版,提升可读性,同时完全免费使用,无需安装、下载...

音频提取文字工具AIbase音频提取文字工具利用人工智能技术,通过机器学习模型快速生成高质量的音频文本描述,优化文本排版,提升可读性,同时完全免费使用,无需安装、下载... -

Vibe CoderVibe Coder 是由 Deepgram 开发的一款开源 VS Code 扩展,旨在探索语音驱动编程的可能性。它利用语音识别技术,让用户通过语音指...

Vibe CoderVibe Coder 是由 Deepgram 开发的一款开源 VS Code 扩展,旨在探索语音驱动编程的可能性。它利用语音识别技术,让用户通过语音指... -

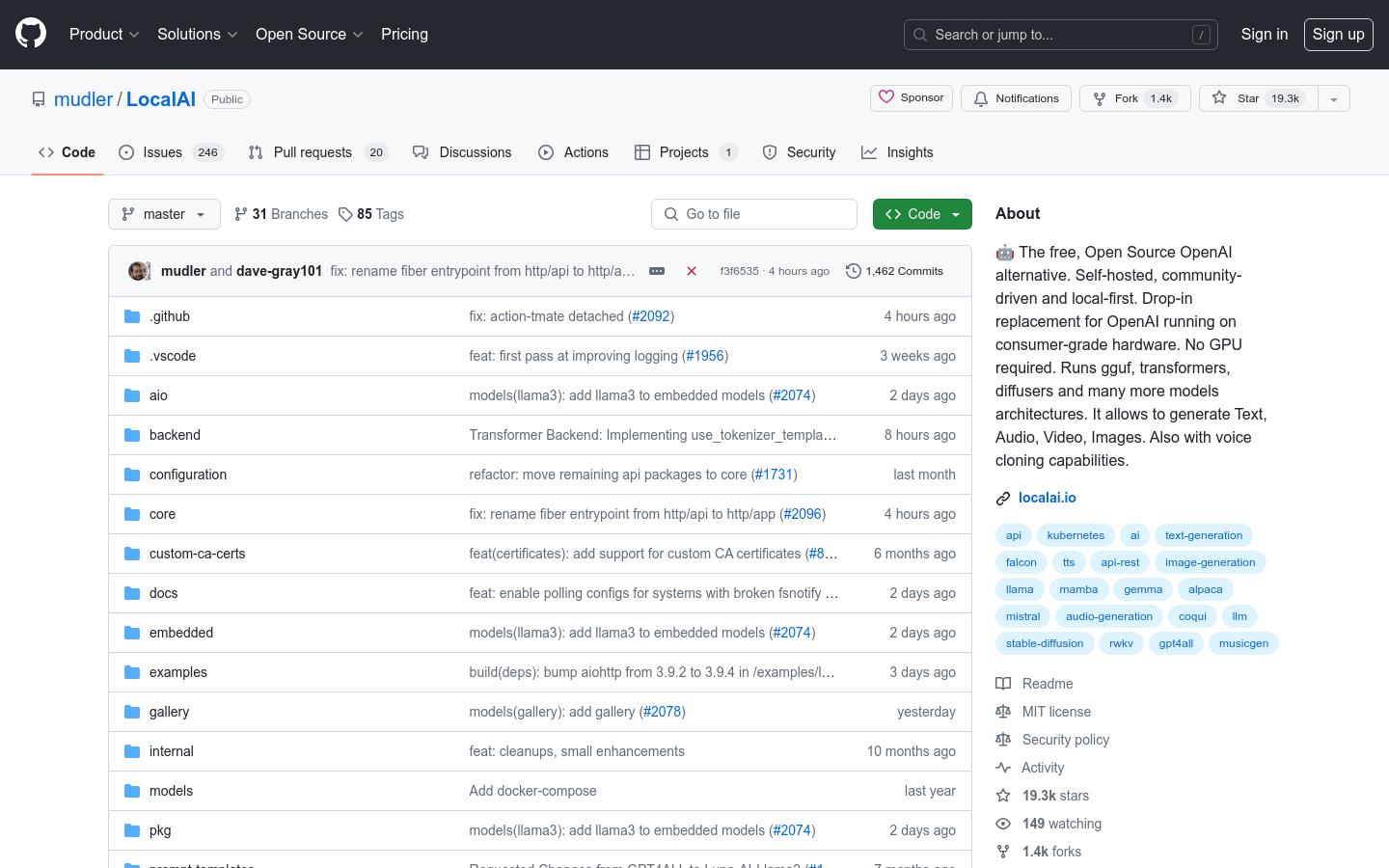

LocalAILocalAI 是一个自托管的开源 OpenAI 替代品,可在消费级硬件上运行,支持本地或本地部署的文本、音频、图像生成。它提供了 GPT 等模型的文...

LocalAILocalAI 是一个自托管的开源 OpenAI 替代品,可在消费级硬件上运行,支持本地或本地部署的文本、音频、图像生成。它提供了 GPT 等模型的文... -

团子AI团子AI是一款在线的人工智能工具箱,提供伴奏人声提取、任意乐器分离、无损升降调等实用功能。基于云计算,使用简单,无需下载安装就可以随时随地使用。通过深...

团子AI团子AI是一款在线的人工智能工具箱,提供伴奏人声提取、任意乐器分离、无损升降调等实用功能。基于云计算,使用简单,无需下载安装就可以随时随地使用。通过深... -

CSM 1BCSM 1B 是一个基于 Llama 架构的语音生成模型,能够从文本和音频输入中生成 RVQ 音频代码。该模型主要应用于语音合成领域,具有高质量的语音...

CSM 1BCSM 1B 是一个基于 Llama 架构的语音生成模型,能够从文本和音频输入中生成 RVQ 音频代码。该模型主要应用于语音合成领域,具有高质量的语音... -

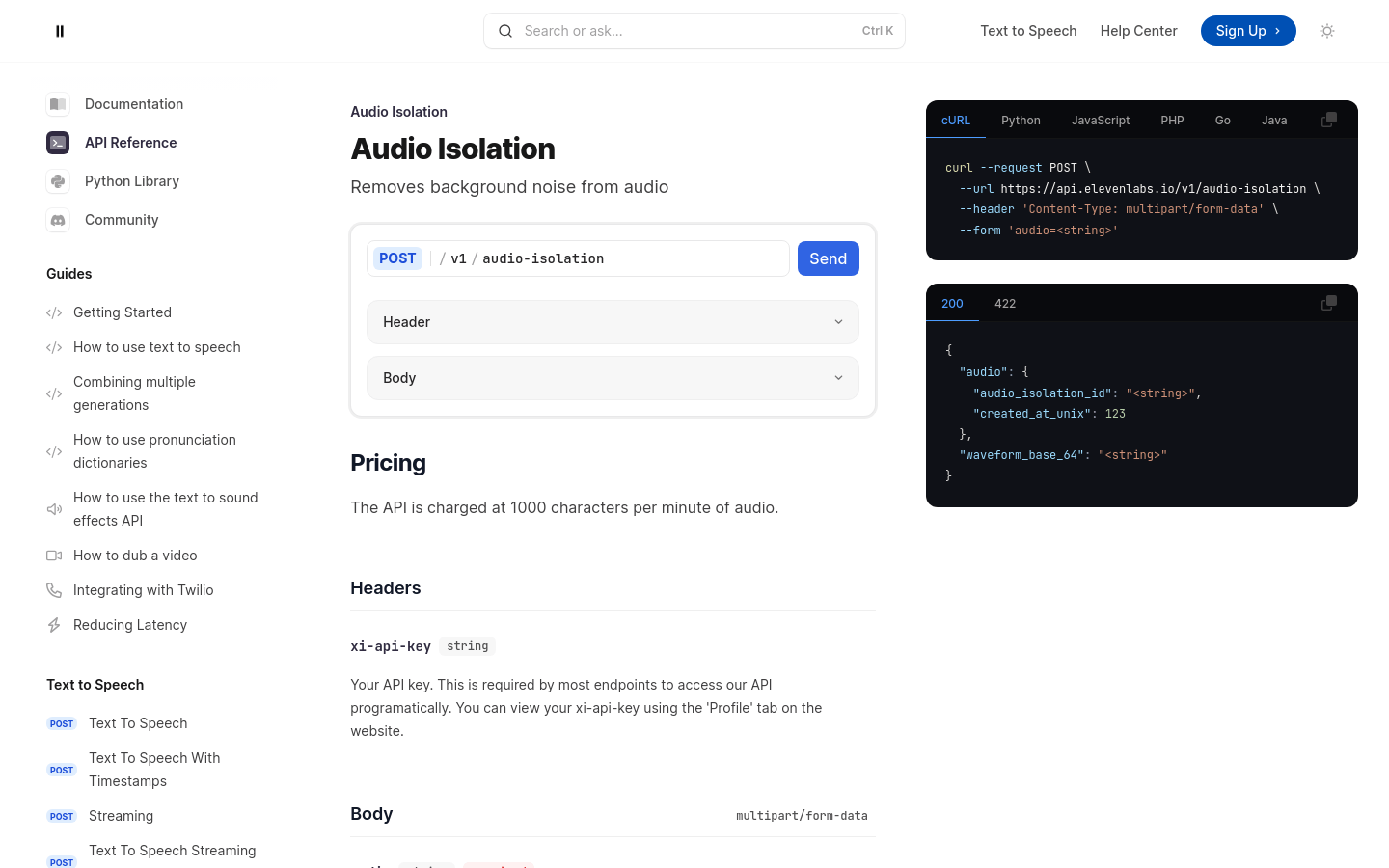

ElevenLabs Audio Isolation APIAudio Isolation 是 ElevenLabs 提供的一项在线音频处理服务,专注于从音频中分离出人声或背景音乐。这项技术在音乐制作、视频后期...

ElevenLabs Audio Isolation APIAudio Isolation 是 ElevenLabs 提供的一项在线音频处理服务,专注于从音频中分离出人声或背景音乐。这项技术在音乐制作、视频后期... -

Seed-TTSSeed-TTS是由字节跳动推出的一系列大规模自回归文本到语音(TTS)模型,能够生成与人类语音难以区分的语音。它在语音上下文学习、说话人相似度和自然...

Seed-TTSSeed-TTS是由字节跳动推出的一系列大规模自回归文本到语音(TTS)模型,能够生成与人类语音难以区分的语音。它在语音上下文学习、说话人相似度和自然... -

WavoAIWavoAI是一款自动将音频转换为可操作的文字转录工具,具有高准确性的语音转文字功能和交互式人工智能分析,支持发言人识别、文字注释等功能。其AI助手能...

WavoAIWavoAI是一款自动将音频转换为可操作的文字转录工具,具有高准确性的语音转文字功能和交互式人工智能分析,支持发言人识别、文字注释等功能。其AI助手能... -

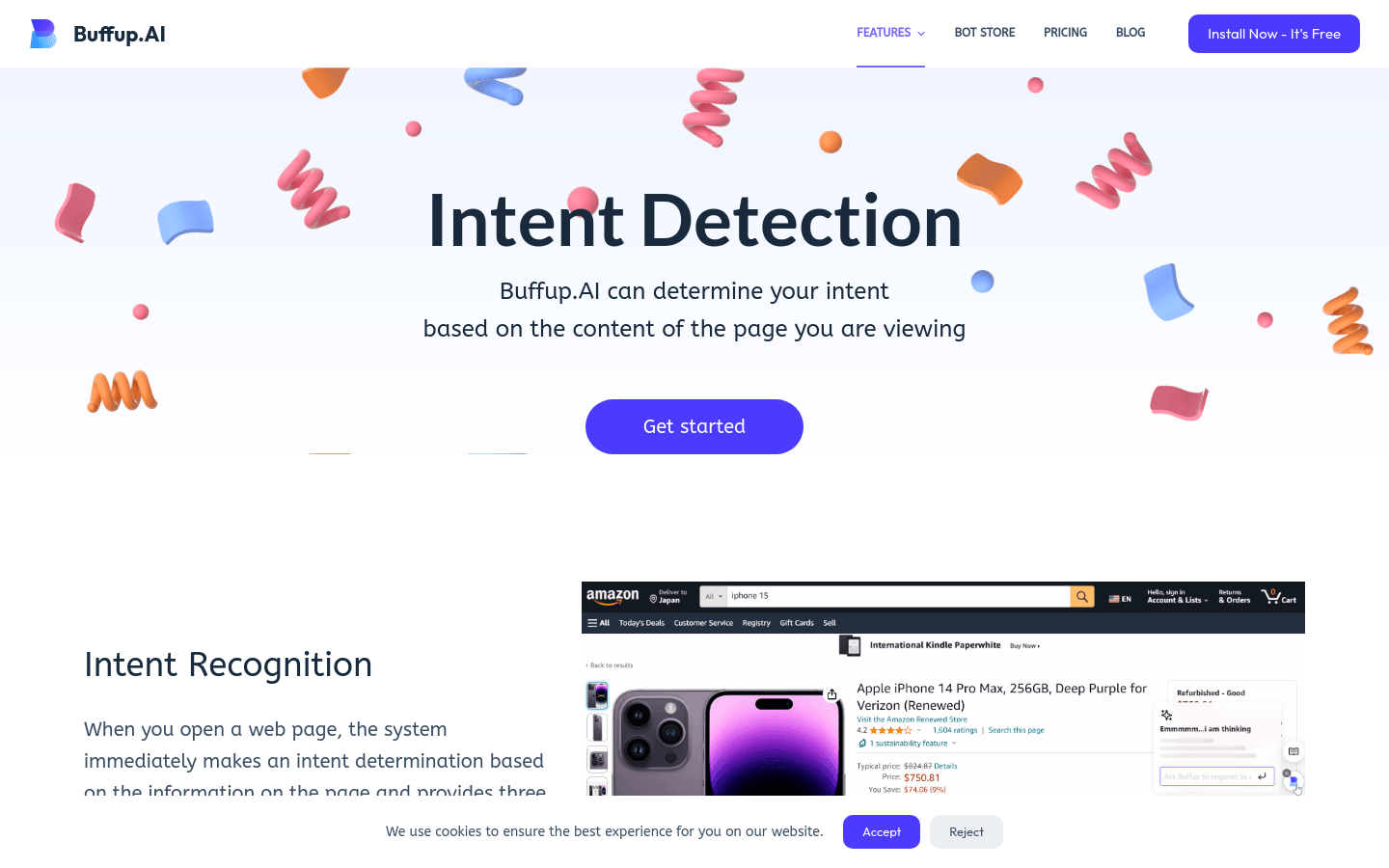

BuffupBuffup.AI 是一款基于 AI 的意图识别工具,可根据页面内容确定用户意图,提供快速的问题回答,并支持持续的意图判断。该产品通过最佳的 AI 模...

BuffupBuffup.AI 是一款基于 AI 的意图识别工具,可根据页面内容确定用户意图,提供快速的问题回答,并支持持续的意图判断。该产品通过最佳的 AI 模... -

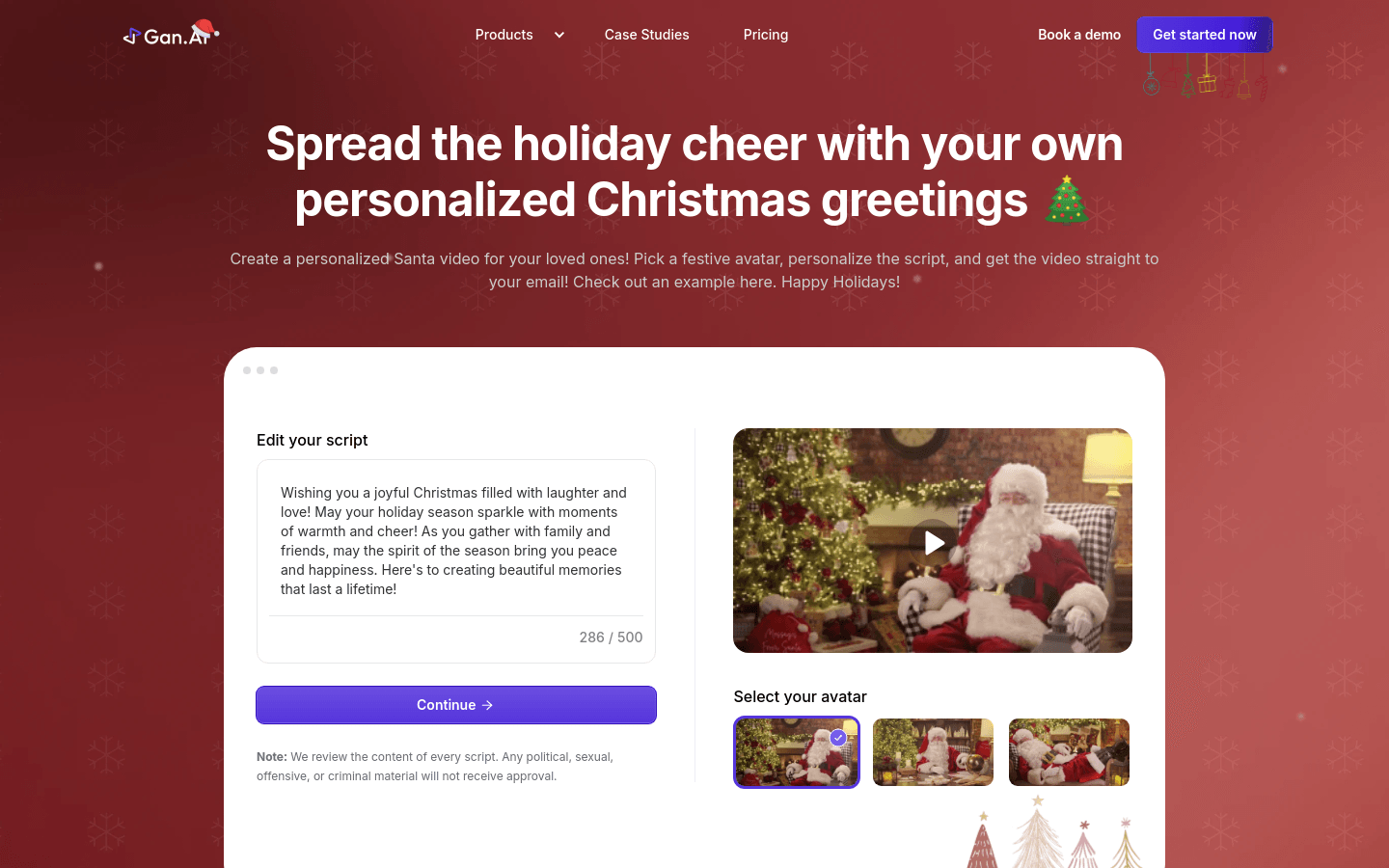

Text to Santa Videos by Gan.AIText to Santa Videos by Gan.AI是一个在线平台,允许用户创建个性化的圣诞老人视频,为亲人和朋友带去节日的问候。该平台通过节...

Text to Santa Videos by Gan.AIText to Santa Videos by Gan.AI是一个在线平台,允许用户创建个性化的圣诞老人视频,为亲人和朋友带去节日的问候。该平台通过节... -

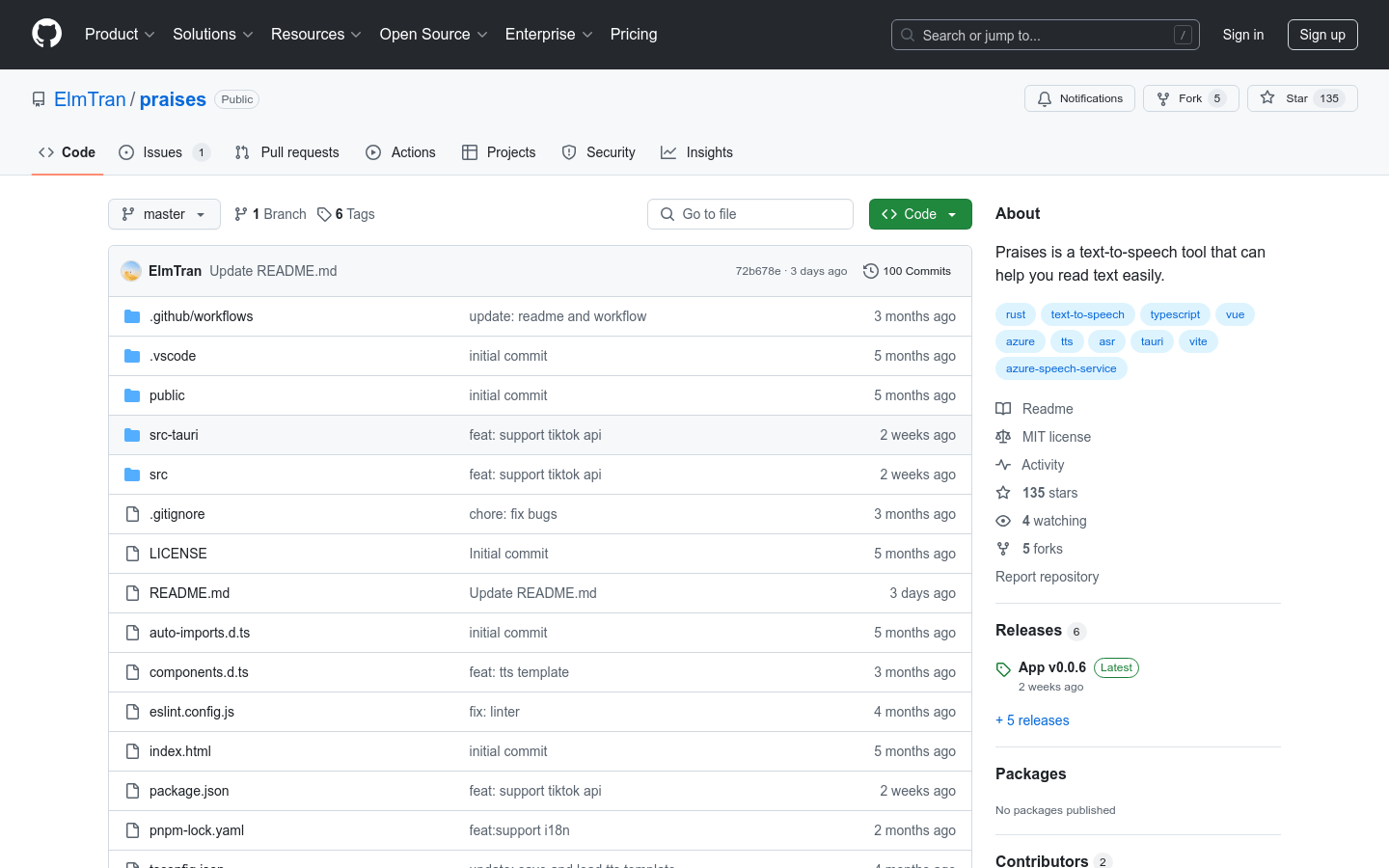

PraisesPraises是一款文本转语音(TTS)工具,它通过将文本转换为语音输出,帮助用户更轻松地获取信息。这款工具支持多种API,包括Azure API、E...

PraisesPraises是一款文本转语音(TTS)工具,它通过将文本转换为语音输出,帮助用户更轻松地获取信息。这款工具支持多种API,包括Azure API、E... -

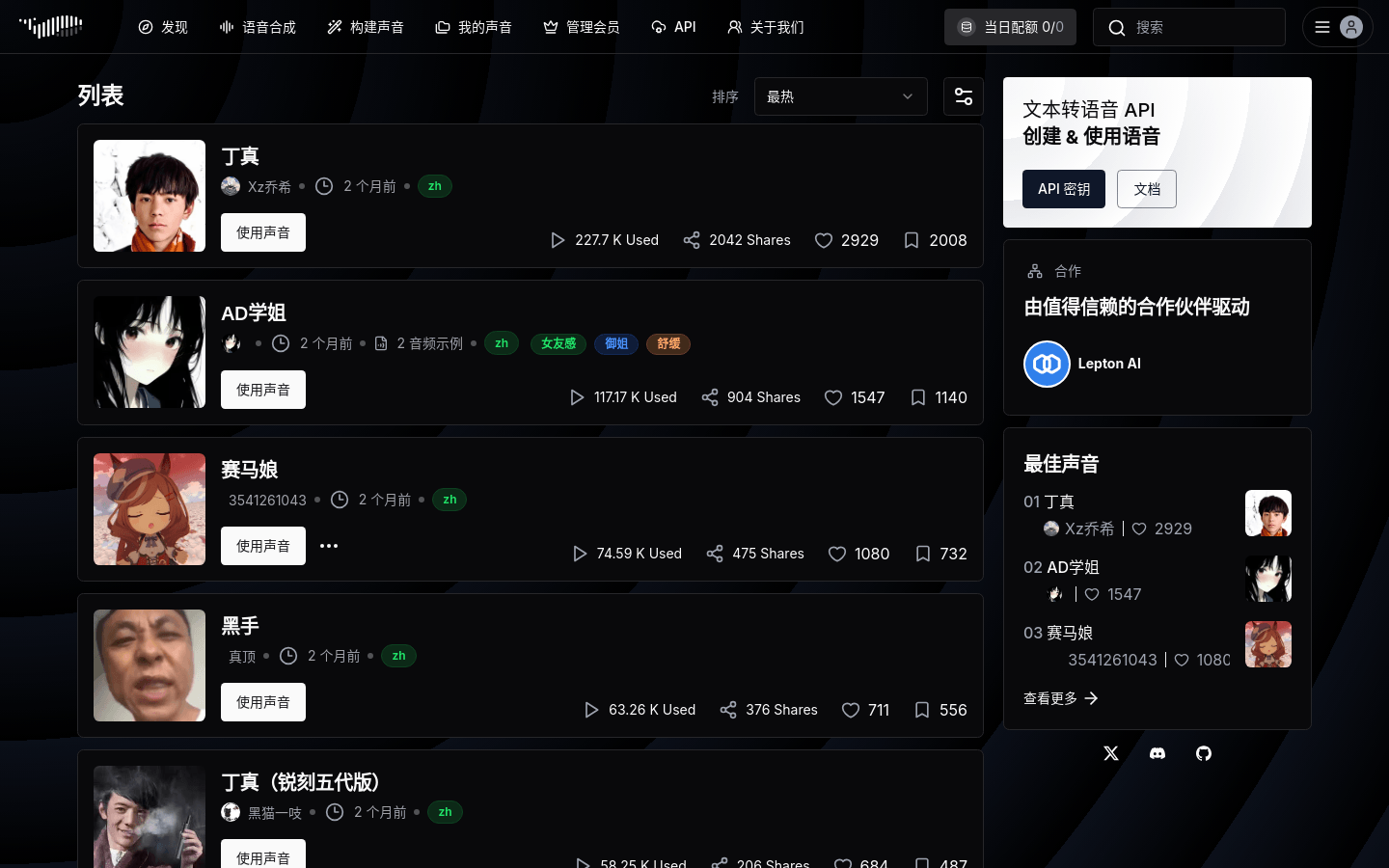

Fish AudioFish Audio是一个提供文本到语音转换服务的平台,利用生成式AI技术,用户可以将文本转换为自然流畅的语音。该平台支持声音克隆技术,允许用户创建和...

Fish AudioFish Audio是一个提供文本到语音转换服务的平台,利用生成式AI技术,用户可以将文本转换为自然流畅的语音。该平台支持声音克隆技术,允许用户创建和...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

copyreadynow

使用CopyReadyNow(基于AI的文案写作工具)来增强您的B2B技术业务,该工具创建了自然,人为编写的内容,例如博客文章,电子邮件序列和社交媒体...

ai interior design

为您的下一个室内或外部重塑项目体验AI室内设计。我们支持AI的工具具有强大的人工智能引擎,可帮助您快速,准确地创建完美的设计。借助AI室内设计,您可以...

Deep Review by SciSpace

Deep Review by SciSpace 是一款面向科研人员和学者的深度文献综述工具。它利用人工智能技术,帮助用户快速完成系统性文献综述,确保不...

ChatGPT Gov

ChatGPT Gov是OpenAI为美国政府机构量身定制的AI模型版本,旨在帮助政府机构高效利用AI技术解决复杂问题。它基于OpenAI的前沿技术,...

YuE-s1-7B-anneal-en-cot

YuE是一个开创性的开源基础模型系列,专为音乐生成设计,能够将歌词转化为完整的歌曲。它能够生成包含吸引人的主唱和配套伴奏的完整歌曲,支持多种音乐风格。...

Midjourney

Midjourney是一个独立的研究实验室,致力于探索新型思维媒介,扩展人类的想象力。它由一个小型自筹资金的团队组成,专注于设计、人力基础设施和人工智...

最新文章

1

2

3

4

5

6

7

8

9

10