上一个

Mikrotakt下一个

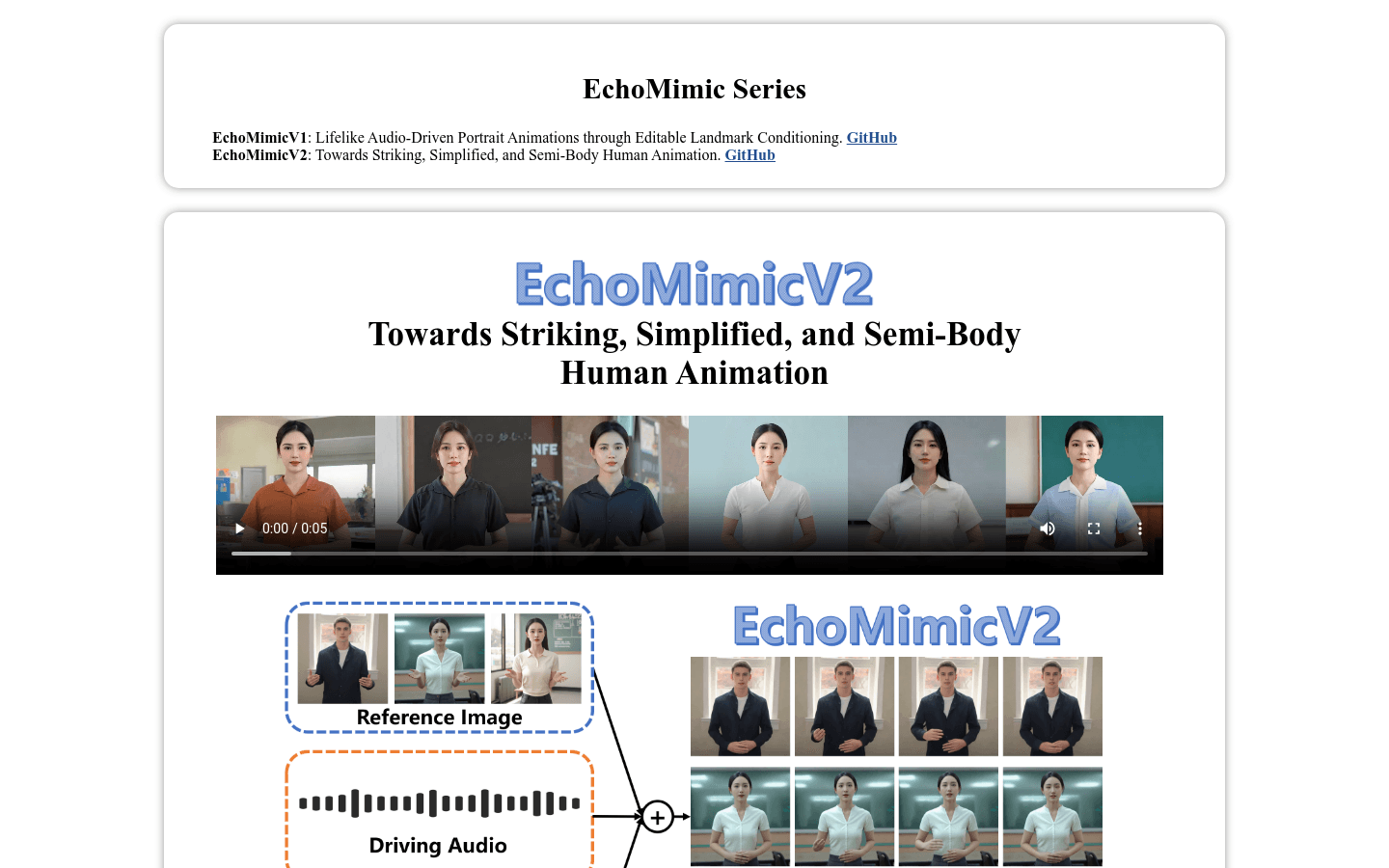

EchoMimicV2

相关AI工具集

-

Agent MAgent M是一个强大的大型语言模型或ChatGPT驱动的主代理开发框架,可让您创建多个基于LLM的代理。Agent Mbetween多个执行各种任...

Agent MAgent M是一个强大的大型语言模型或ChatGPT驱动的主代理开发框架,可让您创建多个基于LLM的代理。Agent Mbetween多个执行各种任... -

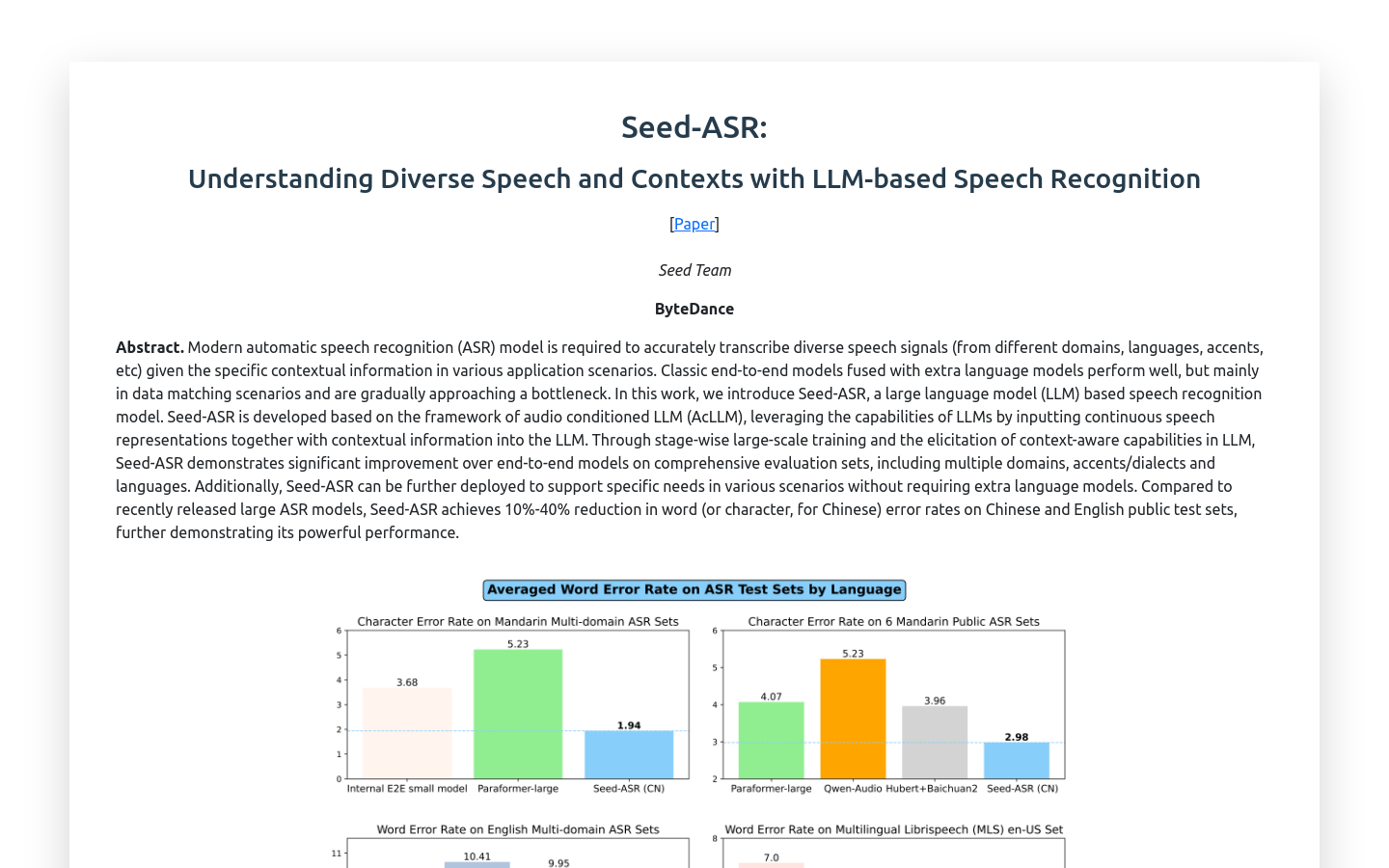

Seed-ASRSeed-ASR是由字节跳动公司开发的基于大型语言模型(Large Language Model, LLM)的语音识别模型。它通过将连续的语音表示和上...

Seed-ASRSeed-ASR是由字节跳动公司开发的基于大型语言模型(Large Language Model, LLM)的语音识别模型。它通过将连续的语音表示和上... -

Text2MultimediaText2Multimedia是一款使用开源AI模型将文本转换为图像或语音的工具。该工具提供了文本转图像和文本转语音的功能,用户可以通过描述文本来生成...

Text2MultimediaText2Multimedia是一款使用开源AI模型将文本转换为图像或语音的工具。该工具提供了文本转图像和文本转语音的功能,用户可以通过描述文本来生成... -

KonchKonch是一款出色的自动转录平台,支持30多种语言。它使用先进的AI技术,快速准确地将音频或视频文件转录成文本。用户可以选择完全由AI生成的转录结果...

KonchKonch是一款出色的自动转录平台,支持30多种语言。它使用先进的AI技术,快速准确地将音频或视频文件转录成文本。用户可以选择完全由AI生成的转录结果... -

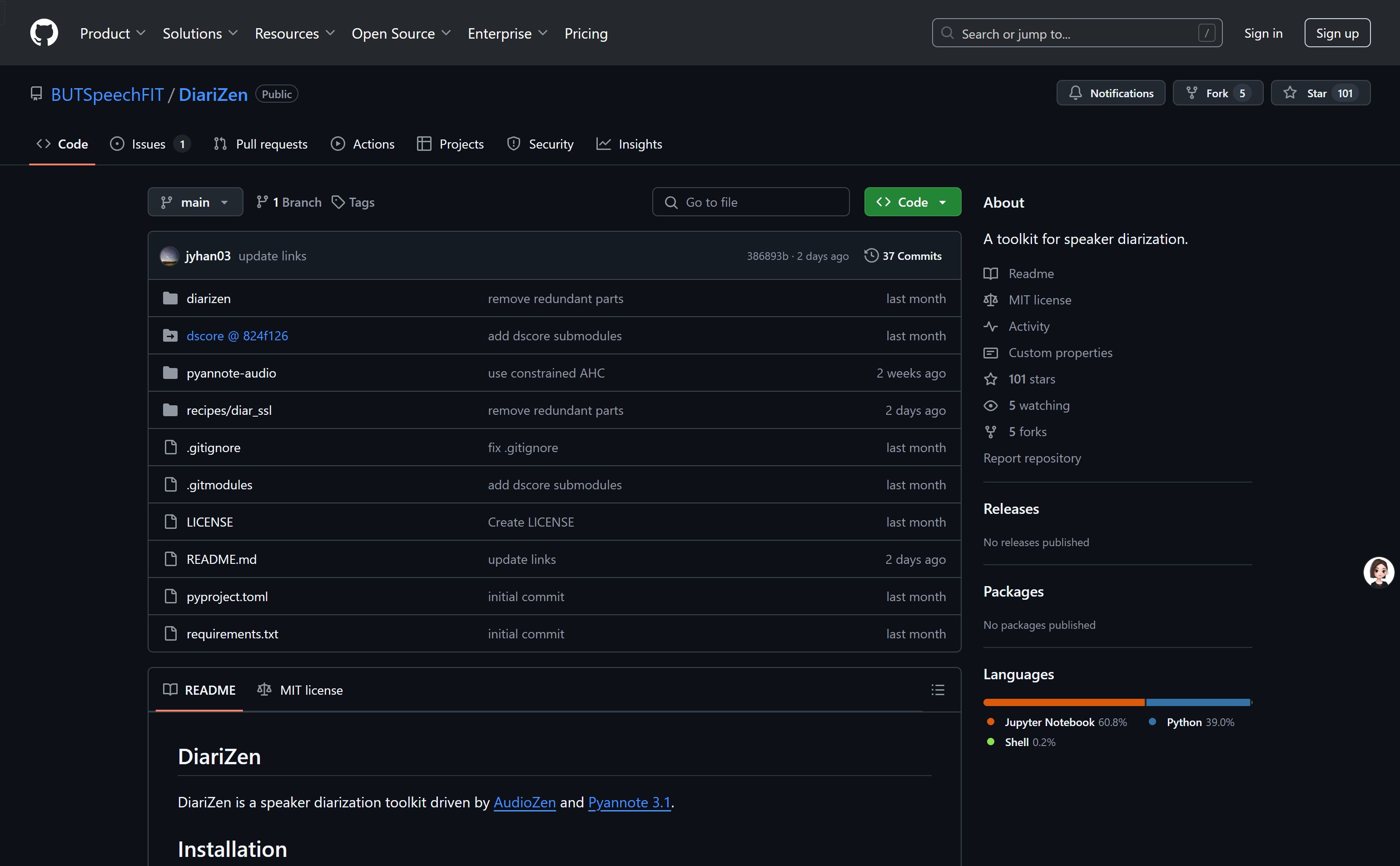

DiariZenDiariZen是一个基于AudioZen和Pyannote 3.1驱动的说话人分割工具包。说话人分割是音频处理中的一个关键步骤,它能够将一段音频中的...

DiariZenDiariZen是一个基于AudioZen和Pyannote 3.1驱动的说话人分割工具包。说话人分割是音频处理中的一个关键步骤,它能够将一段音频中的... -

OuttloudOuttloud是一款AI语音助手,可以将用户文档或文本转换成自然流畅的高保真AI语音。它支持超过10种语言和口音,提供100多种AI高级人声。用户可...

OuttloudOuttloud是一款AI语音助手,可以将用户文档或文本转换成自然流畅的高保真AI语音。它支持超过10种语言和口音,提供100多种AI高级人声。用户可... -

闪念贝壳闪念贝壳是一款以语音记录为核心的思考笔记应用,通过AI技术帮助用户捕捉灵感、整理思绪,并指导行动。它支持声音、图片、文本等多种记录方式,能够自动整理、...

闪念贝壳闪念贝壳是一款以语音记录为核心的思考笔记应用,通过AI技术帮助用户捕捉灵感、整理思绪,并指导行动。它支持声音、图片、文本等多种记录方式,能够自动整理、... -

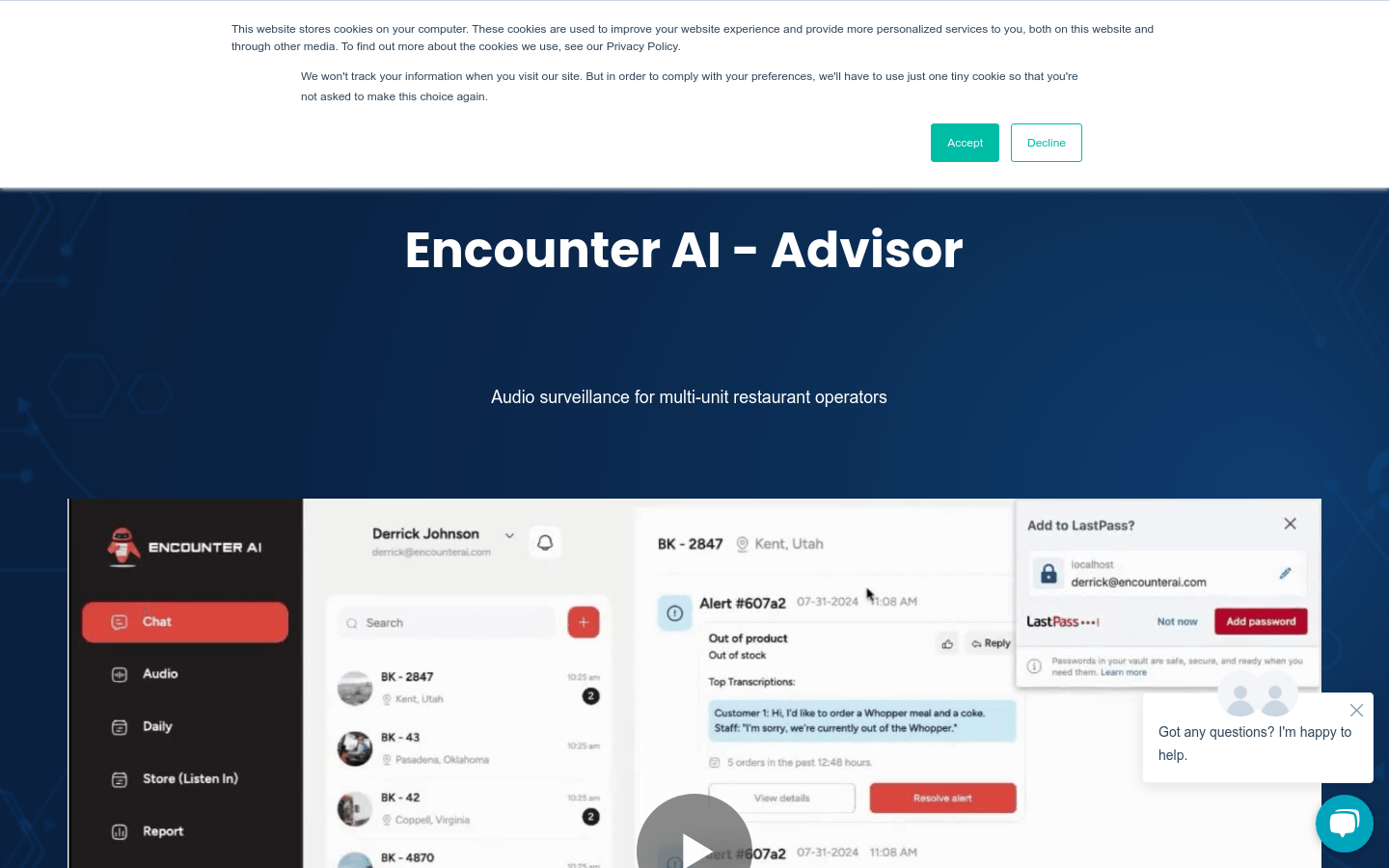

Encounter AI AdvisorEncounter AI - Advisor是一款利用SRI的隐马尔可夫模型(HMM)基础的语音识别技术,为多单位餐厅运营商提供实时的音频监控服务。它...

Encounter AI AdvisorEncounter AI - Advisor是一款利用SRI的隐马尔可夫模型(HMM)基础的语音识别技术,为多单位餐厅运营商提供实时的音频监控服务。它... -

finevoice speech to textFineVoice语音对文本是一种AI转录工具,可以从音频中生成文本。它支持40多种主流语言,并且可以在几分钟内生成成绩单。人工智能技术保证了成绩单的...

finevoice speech to textFineVoice语音对文本是一种AI转录工具,可以从音频中生成文本。它支持40多种主流语言,并且可以在几分钟内生成成绩单。人工智能技术保证了成绩单的... -

Wondercraft AIWondercraft AI是一个AI音频制作工具,可以将现有内容转化为引人入胜的播客,从创意到发布只需几分钟。无论是企业、通讯简报还是出版物,都可以...

Wondercraft AIWondercraft AI是一个AI音频制作工具,可以将现有内容转化为引人入胜的播客,从创意到发布只需几分钟。无论是企业、通讯简报还是出版物,都可以... -

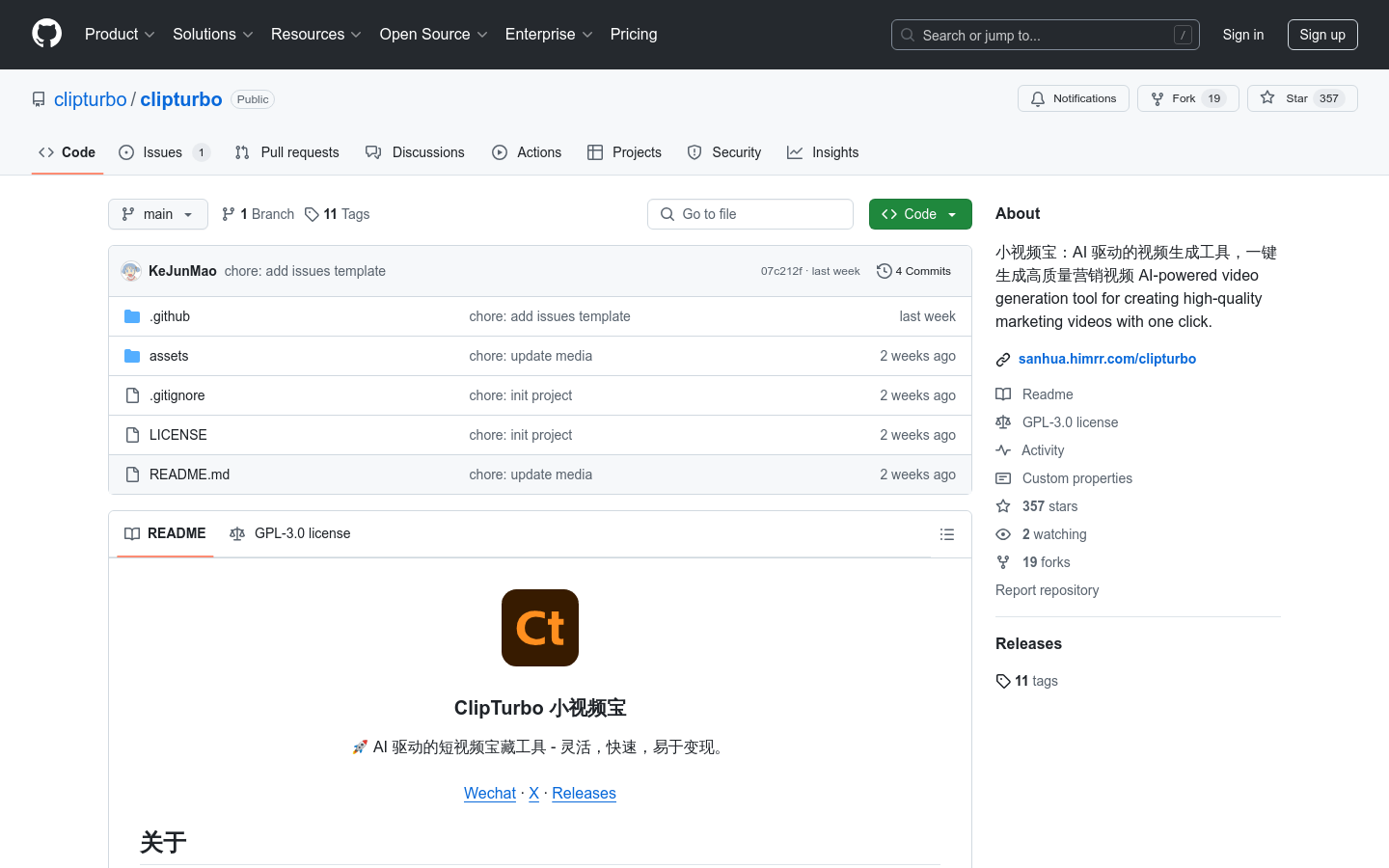

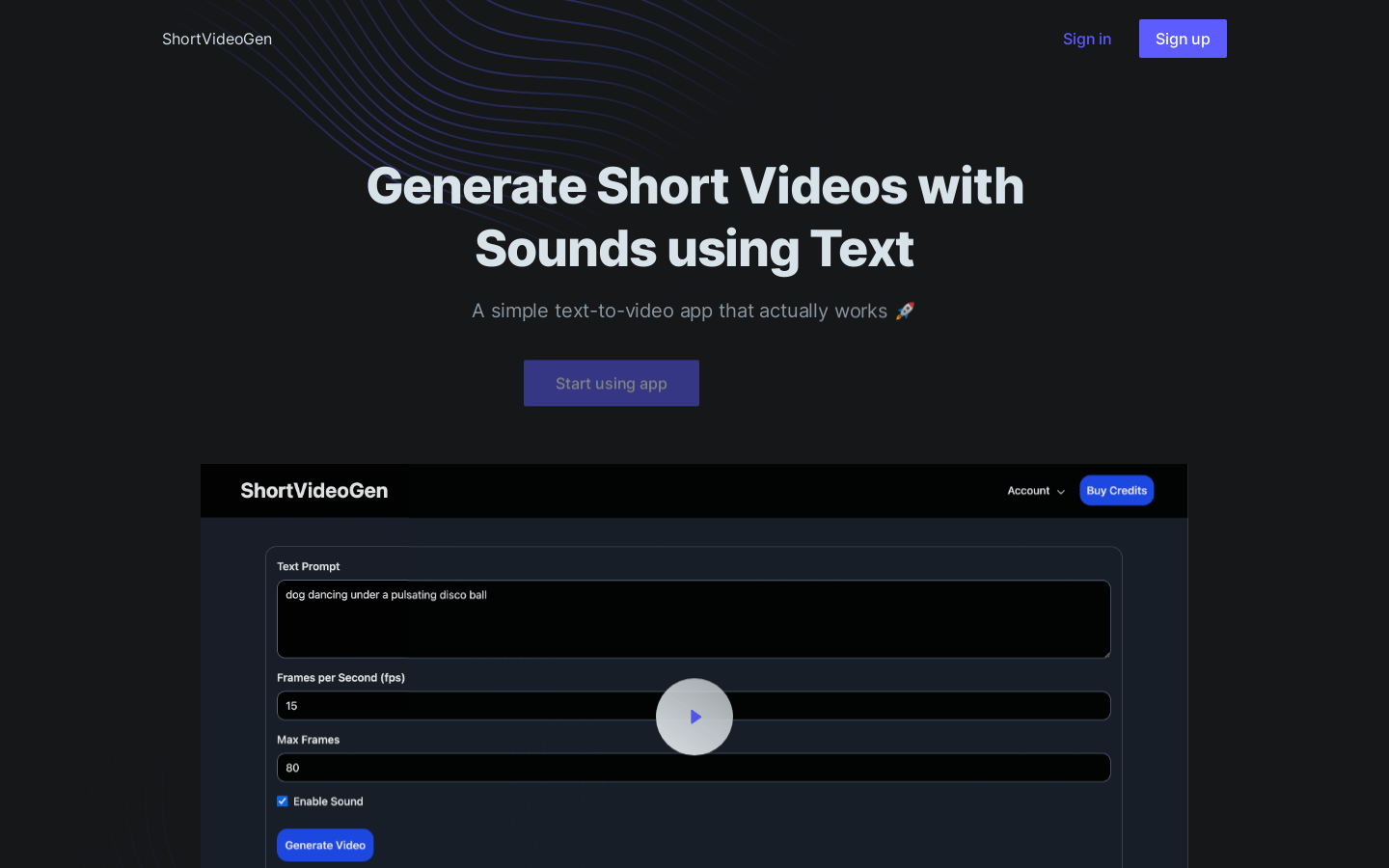

ShortVideoGenShortVideoGen是一个简单易用的文本转视频应用,使用最先进的视频和音频生成AI模型,帮助您在几秒钟内创建个性化视频。只需提交文本提示,指定帧...

ShortVideoGenShortVideoGen是一个简单易用的文本转视频应用,使用最先进的视频和音频生成AI模型,帮助您在几秒钟内创建个性化视频。只需提交文本提示,指定帧... -

Fish Speech V1.2Fish Speech V1.2是一款基于300,000小时的英语、中文和日语音频数据训练而成的文本到语音(TTS)模型。该模型代表了语音合成技术的最...

Fish Speech V1.2Fish Speech V1.2是一款基于300,000小时的英语、中文和日语音频数据训练而成的文本到语音(TTS)模型。该模型代表了语音合成技术的最...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

Le Chat

Mistral AI 提供的 le Chat 是一个免费的生成性AI工作助手,旨在通过前沿的AI技术提升人类的工作效率和创造力。le Chat 结合了...

jobbuddy

JobBuddy AI驱动的求职信生成器使用高级机器学习来创建专门针对您独特的职业资料和目标工作量身定制的个性化专业求职信。乔布迪工具强调您的相关资格...

Freepik Reimagine

Freepik Reimagine是一款基于人工智能的图像创作工具,可以利用先进的AI算法为您的现有图像创建全新的版本和风格。无需繁琐的编辑操作,只需...

Aqora

Aqora 是一个专注于量子计算的在线平台,提供量子竞赛、教程和社区交流,旨在帮助用户学习量子计算知识,提升技能,并与全球专家合作解决实际问题。该平台...

Functions for AI

Functions for AI是一个将AI代理与各种功能连接的平台,使用户能够通过预测API获取正确的功能,收集用户认证,展示审核界面等。该产品通过...

knibble.ai

knibble.ai是一个构建基于ChatGPT的知识库和聊天机器人的在线SaaS平台。用户可以上传PDF文档、网页链接或直接粘贴文本,knibble...

最新文章

1

2

3

4

5

6

7

8

9

10