上一个

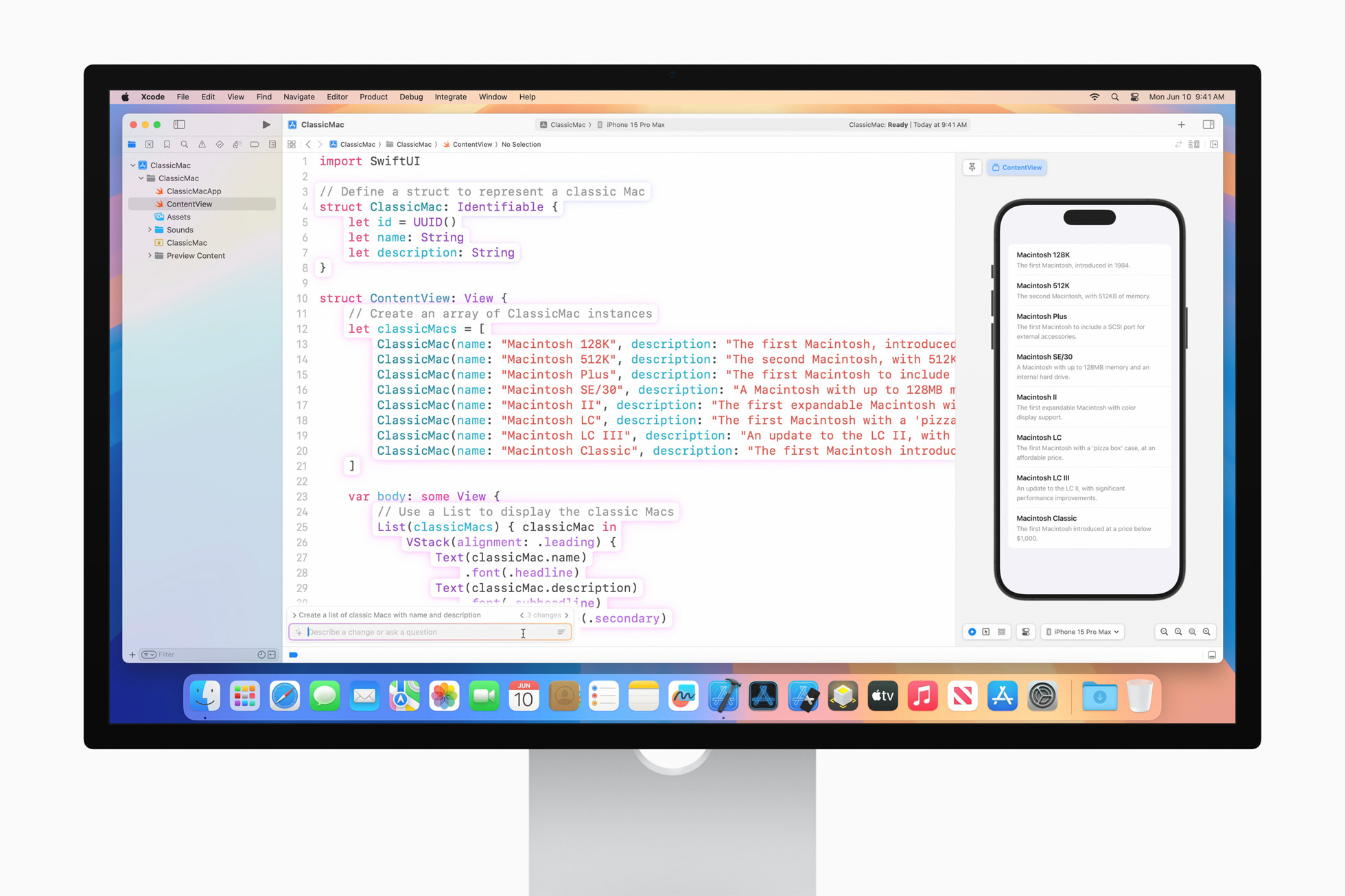

Xcode 16相关AI工具集

-

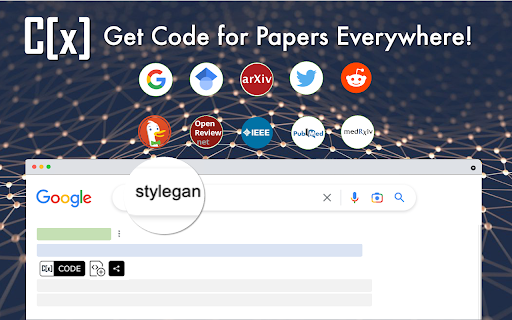

AI Code FinderAI Code Finder是一个免费的浏览器插件,可以快速找到任何AI研究论文的代码实现。它能够自动在Google、ArXiv、学术搜索引擎、论坛等...

AI Code FinderAI Code Finder是一个免费的浏览器插件,可以快速找到任何AI研究论文的代码实现。它能够自动在Google、ArXiv、学术搜索引擎、论坛等... -

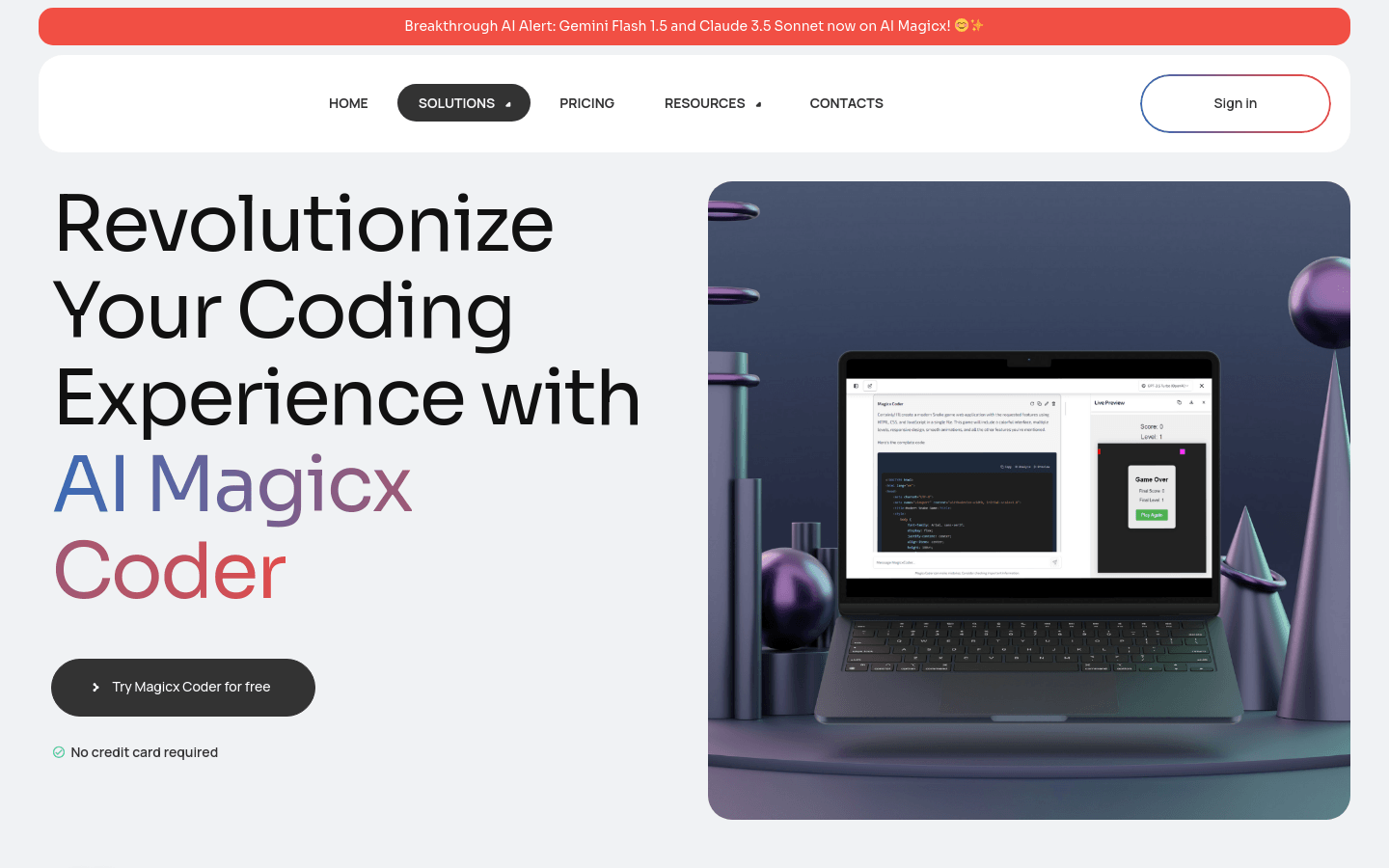

AI Magicx CoderAI Magicx Coder 是一款旨在革新编程体验的在线工具。它通过智能代码分析、实时预览和多模型支持等功能,帮助开发者提高代码质量和效率。产品背...

AI Magicx CoderAI Magicx Coder 是一款旨在革新编程体验的在线工具。它通过智能代码分析、实时预览和多模型支持等功能,帮助开发者提高代码质量和效率。产品背... -

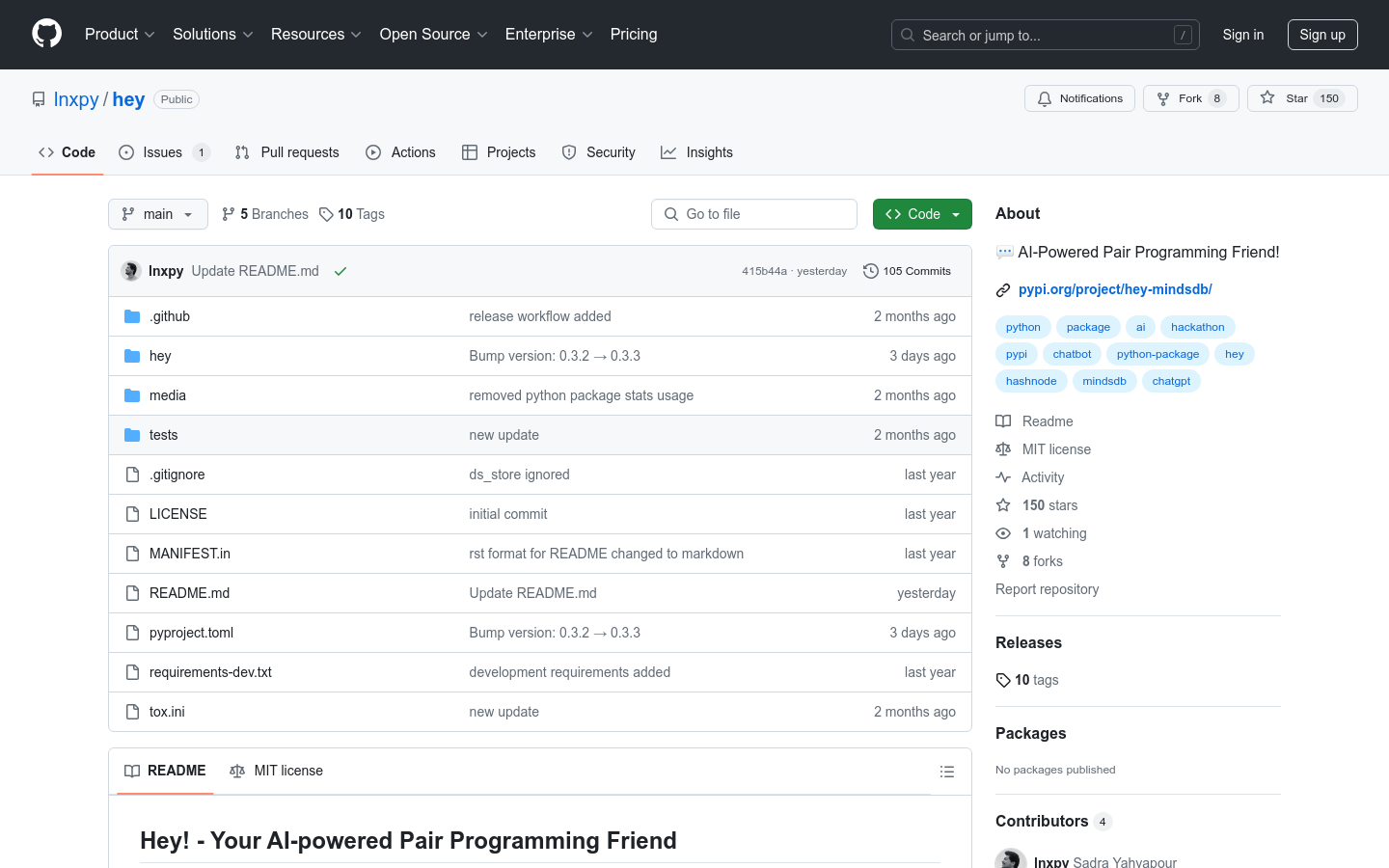

HeyHey是一个基于命令行界面的AI助手,由MindDB支持的ChatGPT AI模型版本驱动。该项目是为Hashnode X MindsDB黑客马拉松设...

HeyHey是一个基于命令行界面的AI助手,由MindDB支持的ChatGPT AI模型版本驱动。该项目是为Hashnode X MindsDB黑客马拉松设... -

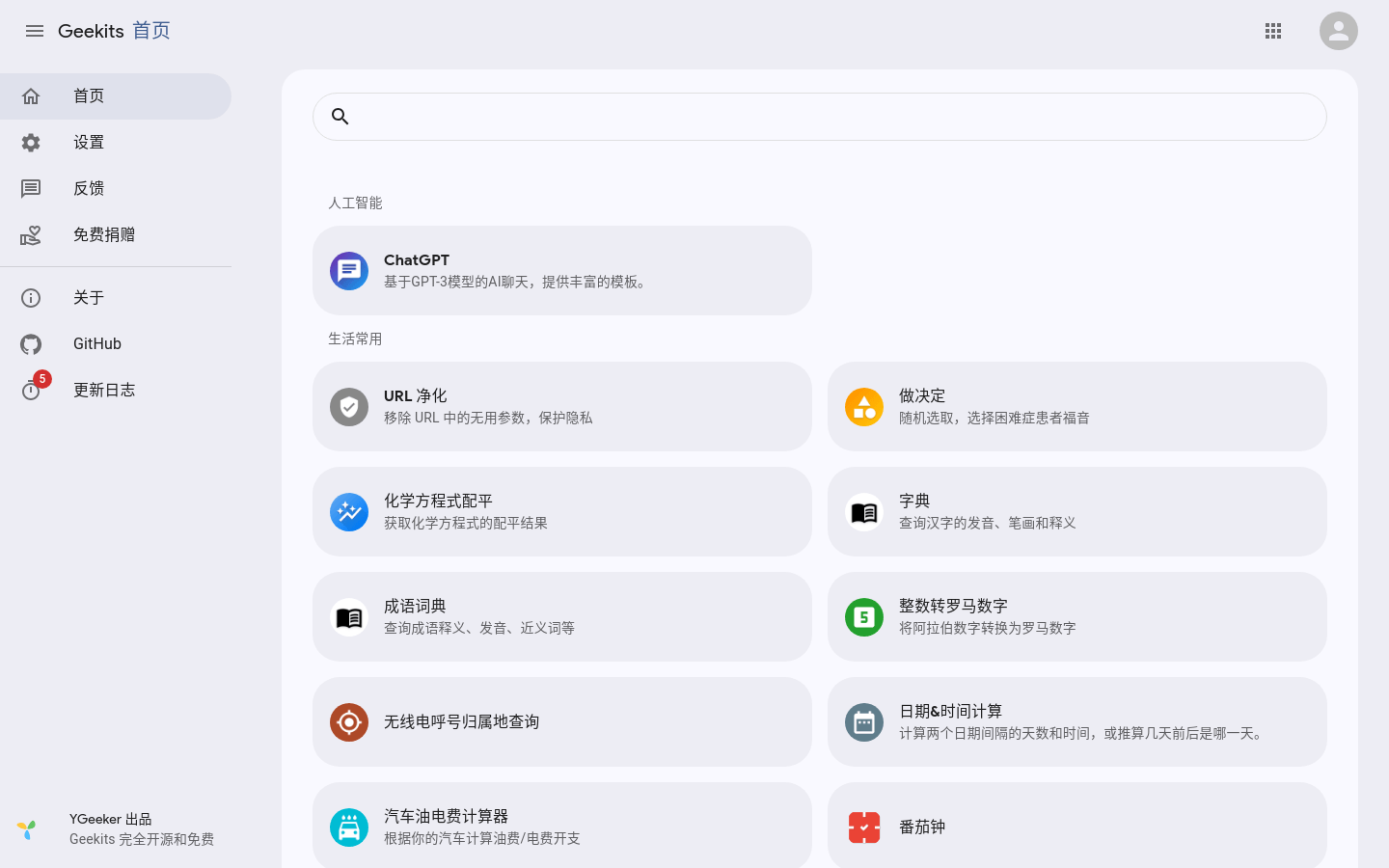

GeekitsGeekits是一个由YGeeker出品的开源和免费的平台,提供了一系列实用工具,包括人工智能、生活常用、图片视频处理、编程开发等多个领域。它不仅为普...

GeekitsGeekits是一个由YGeeker出品的开源和免费的平台,提供了一系列实用工具,包括人工智能、生活常用、图片视频处理、编程开发等多个领域。它不仅为普... -

Trae国内版Trae是一款专为中文开发场景设计的AI原生IDE,将AI技术深度集成于开发环境中。它通过智能代码补全、上下文理解等功能,显著提升开发效率和代码质量。...

Trae国内版Trae是一款专为中文开发场景设计的AI原生IDE,将AI技术深度集成于开发环境中。它通过智能代码补全、上下文理解等功能,显著提升开发效率和代码质量。... -

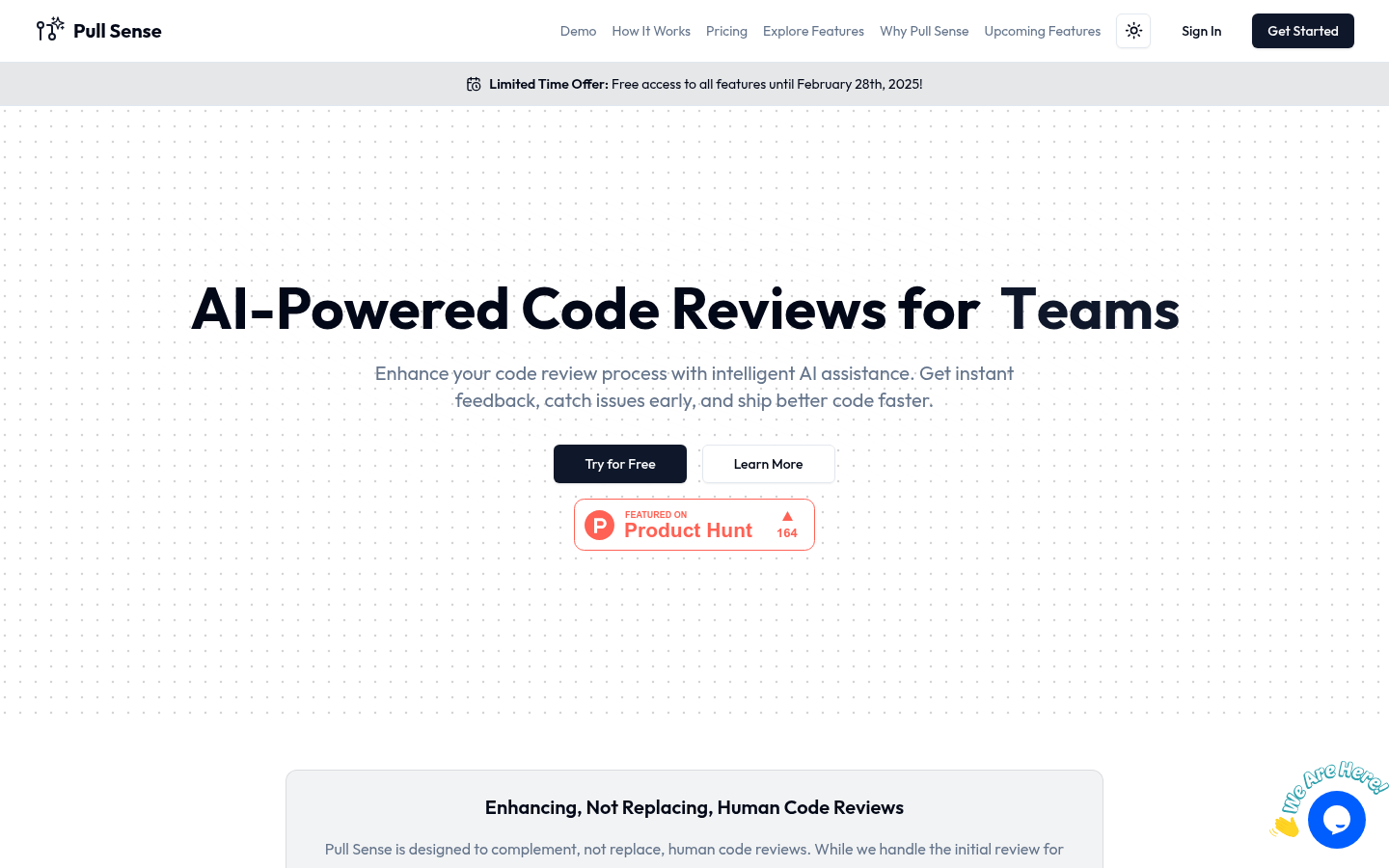

Pull SensePull Sense是一款AI驱动的代码审查工具,专为开发团队设计,旨在通过智能AI辅助提升代码审查效率和质量。它能够快速识别代码中的潜在问题,如漏洞...

Pull SensePull Sense是一款AI驱动的代码审查工具,专为开发团队设计,旨在通过智能AI辅助提升代码审查效率和质量。它能够快速识别代码中的潜在问题,如漏洞... -

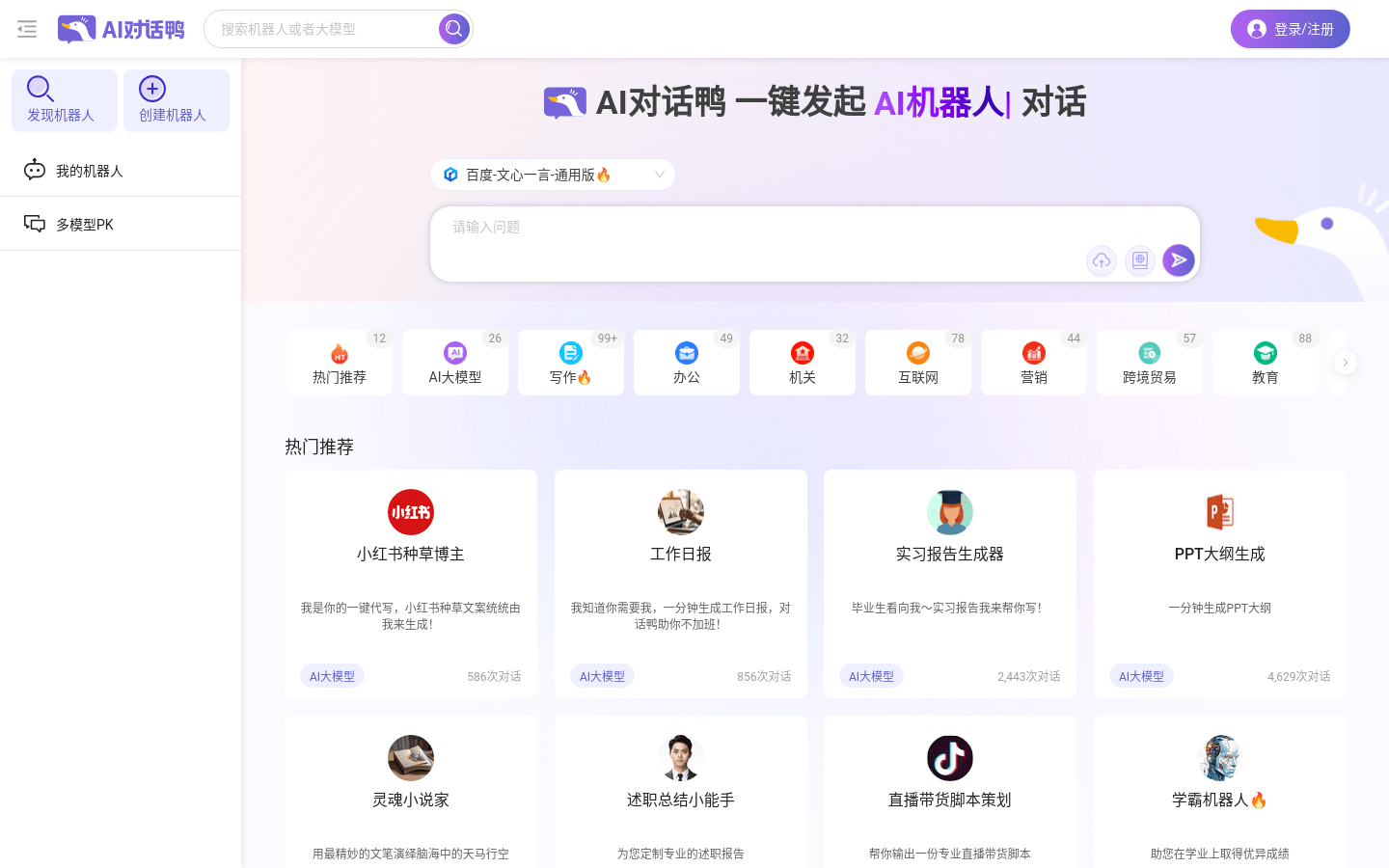

AI对话鸭AI对话鸭是一个领先的AI聊天对话平台,它集成了多款国产大模型,提供了丰富的对话场景和功能,满足不同用户的需求。该平台以其高效的对话生成能力和多样的应...

AI对话鸭AI对话鸭是一个领先的AI聊天对话平台,它集成了多款国产大模型,提供了丰富的对话场景和功能,满足不同用户的需求。该平台以其高效的对话生成能力和多样的应... -

GitHub CopilotGitHub Copilot是一个由GitHub提供的AI驱动的代码补全工具,它通过机器学习技术帮助开发者在编写代码时提供智能的代码建议。该工具集成在...

GitHub CopilotGitHub Copilot是一个由GitHub提供的AI驱动的代码补全工具,它通过机器学习技术帮助开发者在编写代码时提供智能的代码建议。该工具集成在... -

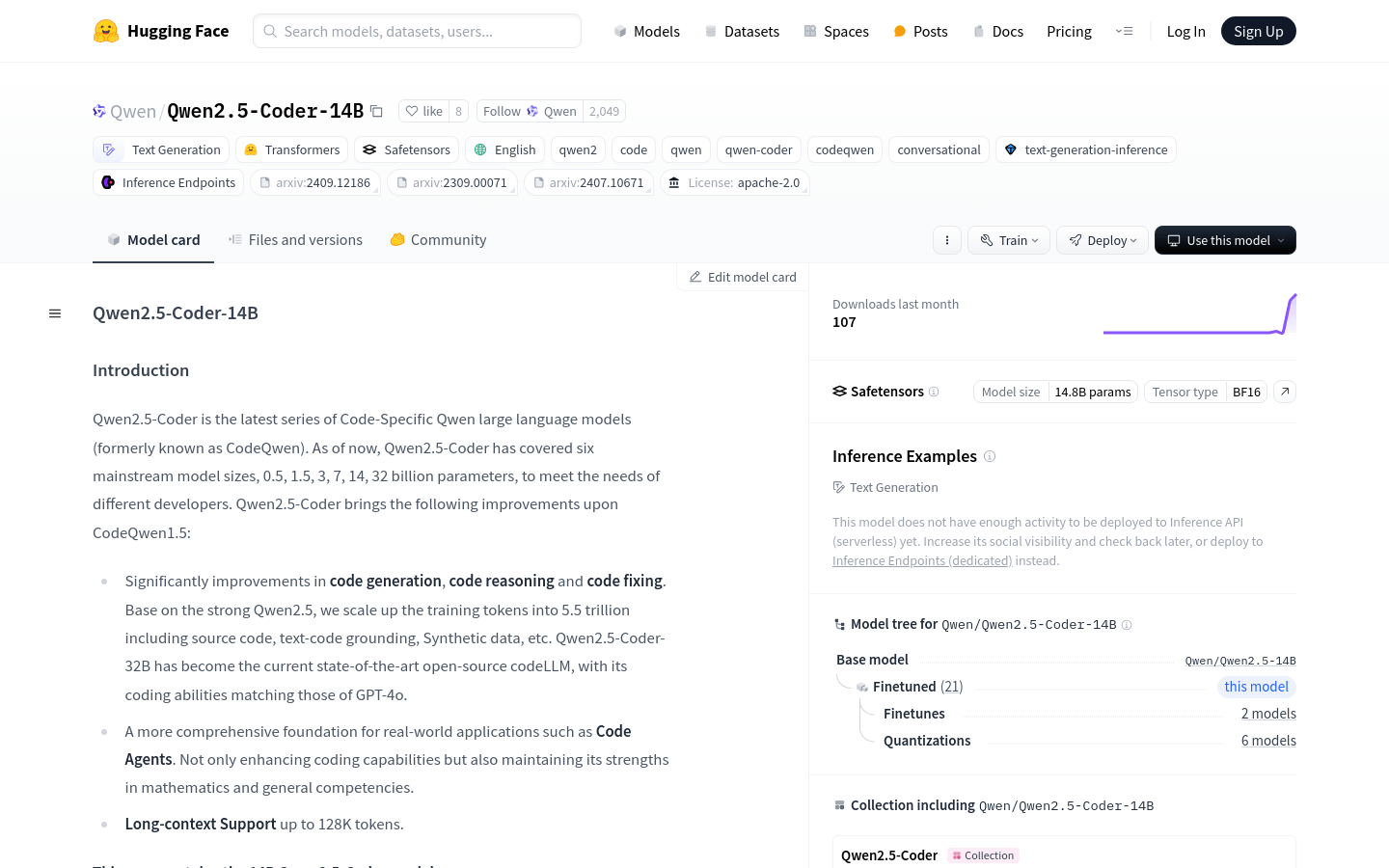

Qwen2.5-Coder-14BQwen2.5-Coder-14B是Qwen系列中专注于代码的大型语言模型,覆盖了0.5到32亿参数的不同模型尺寸,以满足不同开发者的需求。该模型在代...

Qwen2.5-Coder-14BQwen2.5-Coder-14B是Qwen系列中专注于代码的大型语言模型,覆盖了0.5到32亿参数的不同模型尺寸,以满足不同开发者的需求。该模型在代... -

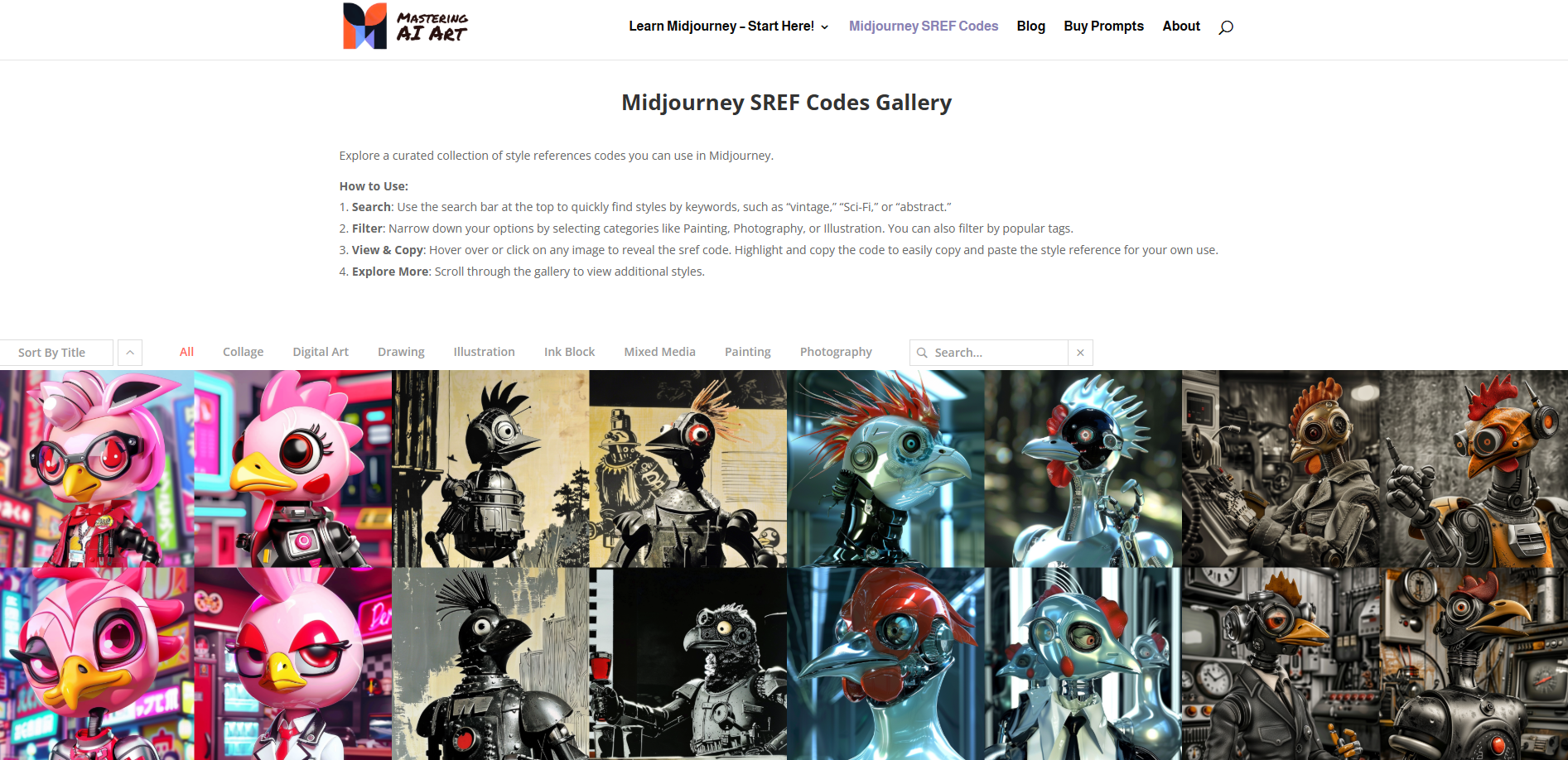

Midjourney SREF Codes GalleryMidjourney SREF Codes 是一个专注于为 Midjourney 用户提供丰富风格参考代码的平台。这些代码涵盖了从复古摄影到未来主义等...

Midjourney SREF Codes GalleryMidjourney SREF Codes 是一个专注于为 Midjourney 用户提供丰富风格参考代码的平台。这些代码涵盖了从复古摄影到未来主义等... -

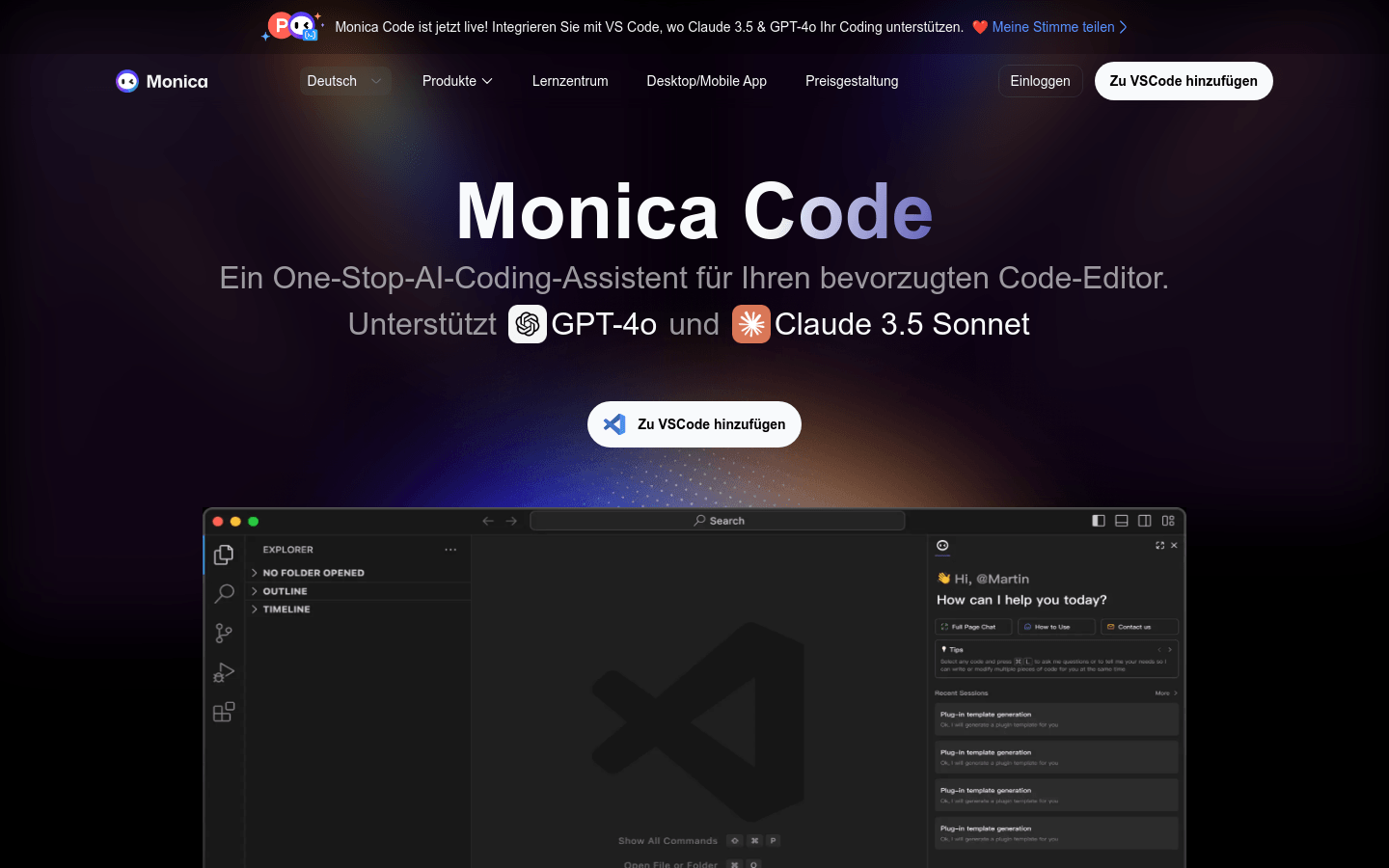

Monica CodeMonica Code是一款集成至VS Code的AI编码助手,支持GPT-4o和Claude 3.5 Sonnet,提供代码补全、代码编辑、与代码库...

Monica CodeMonica Code是一款集成至VS Code的AI编码助手,支持GPT-4o和Claude 3.5 Sonnet,提供代码补全、代码编辑、与代码库... -

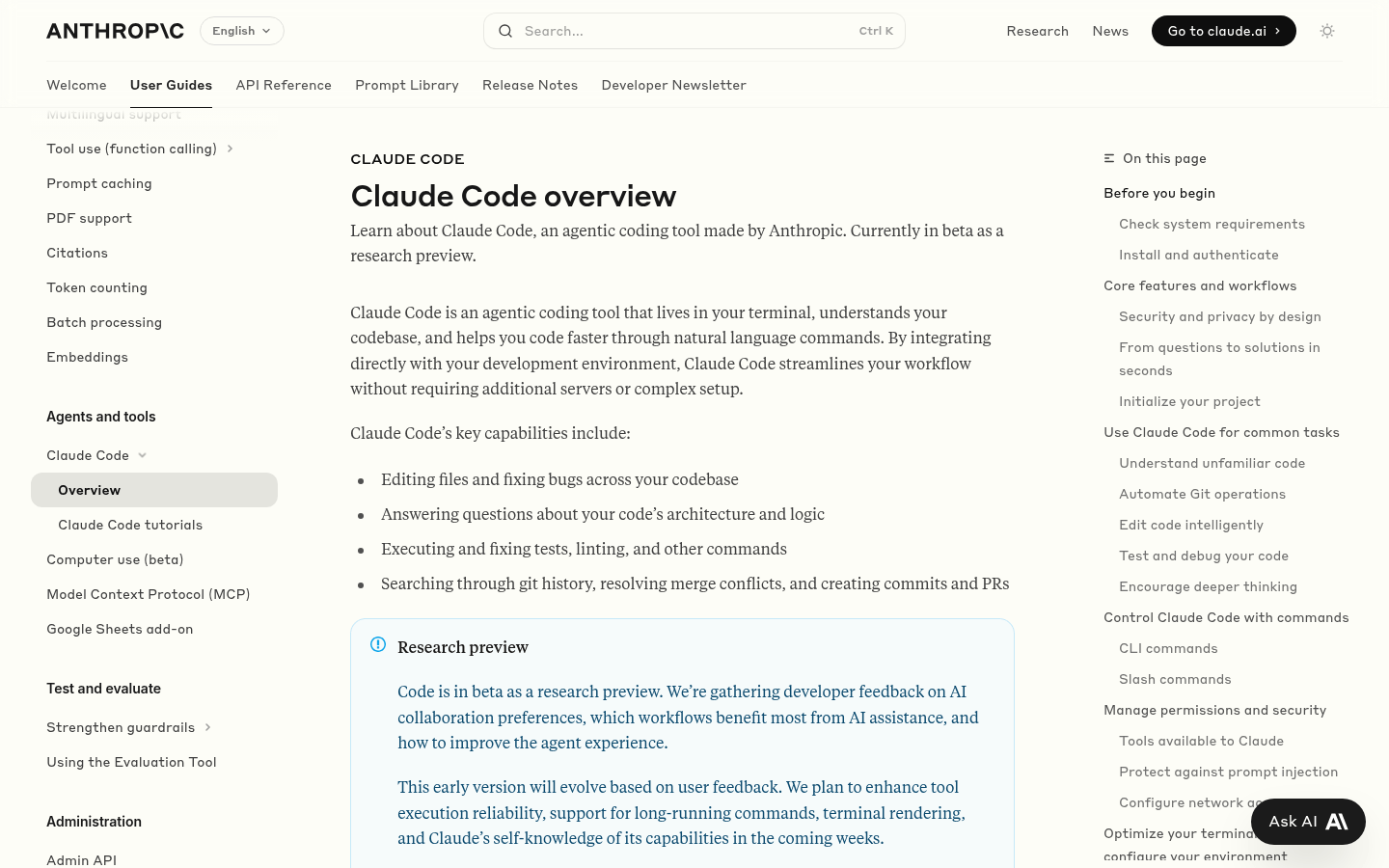

Claude CodeClaude Code 是 Anthropic 推出的一款编程辅助工具,旨在通过自然语言交互提升开发效率。它直接集成在开发环境中,无需额外服务器或复杂...

Claude CodeClaude Code 是 Anthropic 推出的一款编程辅助工具,旨在通过自然语言交互提升开发效率。它直接集成在开发环境中,无需额外服务器或复杂...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

Olvy Changelogs

Olvy Changelogs是一个美观高效的更新日志工具,它可以帮助您向用户宣布新功能,提供独立的更新日志页面和应用内小部件。...

ai magicx

AI MagicX是一套强大的AI内容创建工具的套件。使用AI MagicX,您可以快速,轻松地更快地编写更好的内容。我们的套件具有69+ AI的动力...

AI Game Master

AI Game Master是一款由AI驱动的地下城RPG文字冒险游戏,玩家可以在游戏中扮演英雄角色,选择剧情,通过文本指令进行战斗,并引导故事发展。...

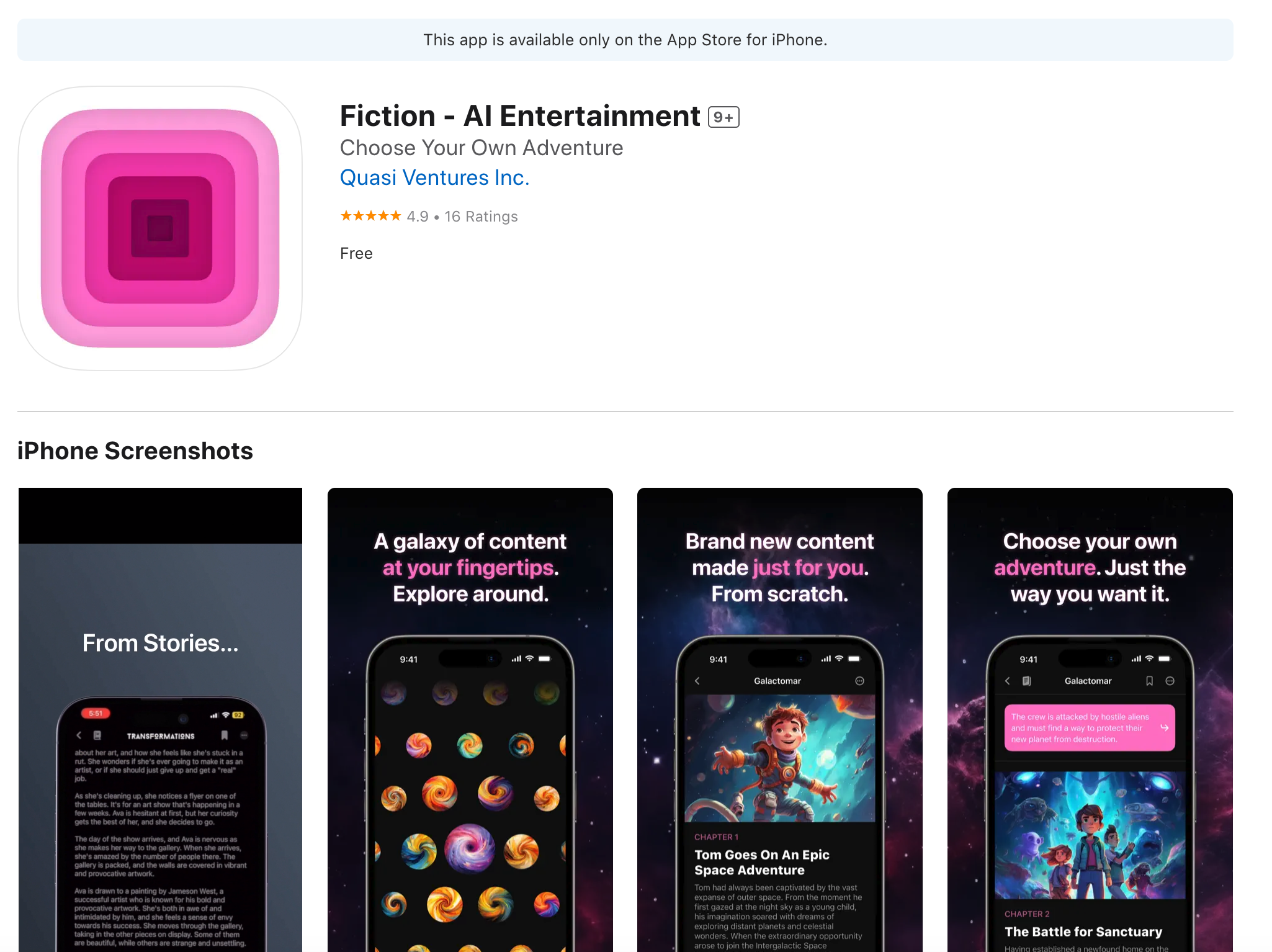

Fiction AI Entertainment

Fiction是一款集人工智能、故事、艺术和漫画于一体的应用。通过智能算法,Fiction为用户提供个性化的故事、艺术和漫画,让用户在阅读、欣赏和创作...

GenColor AI

GenColor AI 采用先进的人工智能技术,能够将用户上传的照片或输入的文字描述快速转换为精美的线稿。其技术的重要性在于为绘画爱好者、艺术创作者以...

HoneyDo

HoneyDo是一款语音识别AI购物清单助手,通过语音输入购物清单,AI将其转化为整洁有序的列表。另外,还支持拍照识别食材并列出清单,以及与家人实时同...

最新文章

1

2

3

4

5

6

7

8

9

10