相关AI工具集

-

AI Code FinderAI Code Finder是一个免费的浏览器插件,可以快速找到任何AI研究论文的代码实现。它能够自动在Google、ArXiv、学术搜索引擎、论坛等...

AI Code FinderAI Code Finder是一个免费的浏览器插件,可以快速找到任何AI研究论文的代码实现。它能够自动在Google、ArXiv、学术搜索引擎、论坛等... -

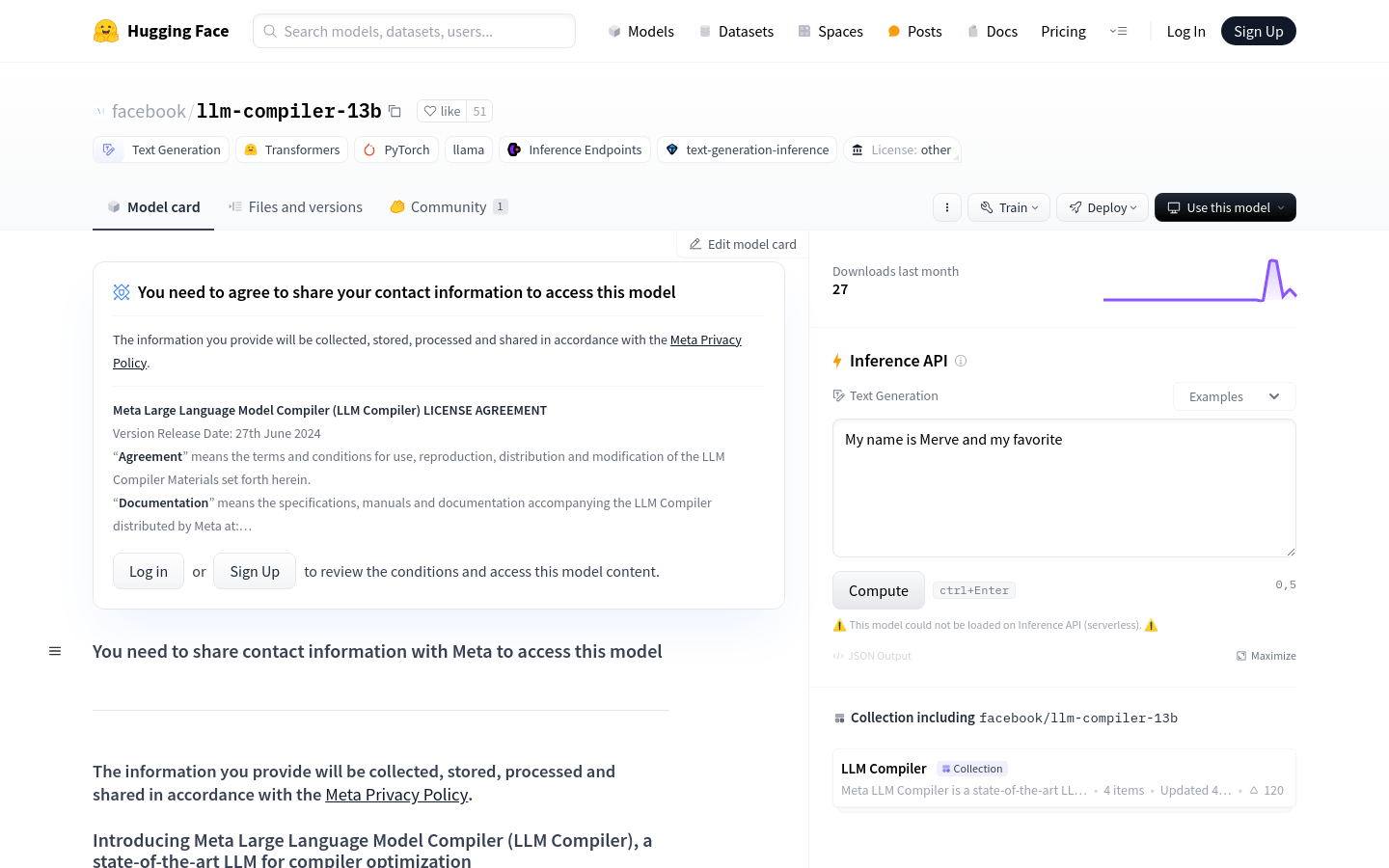

LLM Compiler-13bMeta Large Language Model Compiler (LLM Compiler-13b) 是基于Code Llama构建的,专注于代...

LLM Compiler-13bMeta Large Language Model Compiler (LLM Compiler-13b) 是基于Code Llama构建的,专注于代... -

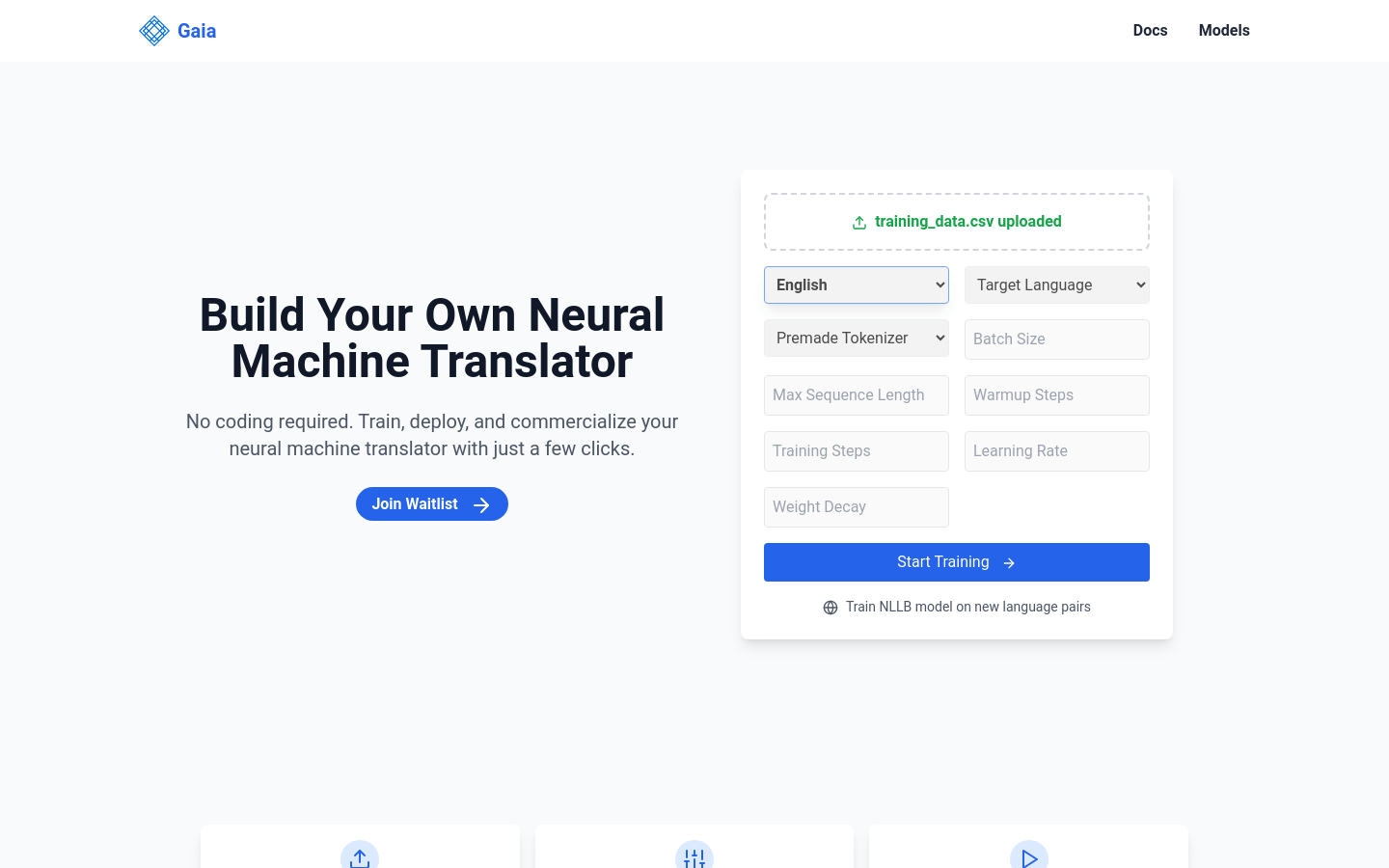

Gaia-mlGaia是一个无需编码即可构建神经机器翻译器(NMT)的工具。它允许用户通过简单的点击操作来训练、部署和商业化自己的神经机器翻译器。该工具支持多语言,...

Gaia-mlGaia是一个无需编码即可构建神经机器翻译器(NMT)的工具。它允许用户通过简单的点击操作来训练、部署和商业化自己的神经机器翻译器。该工具支持多语言,... -

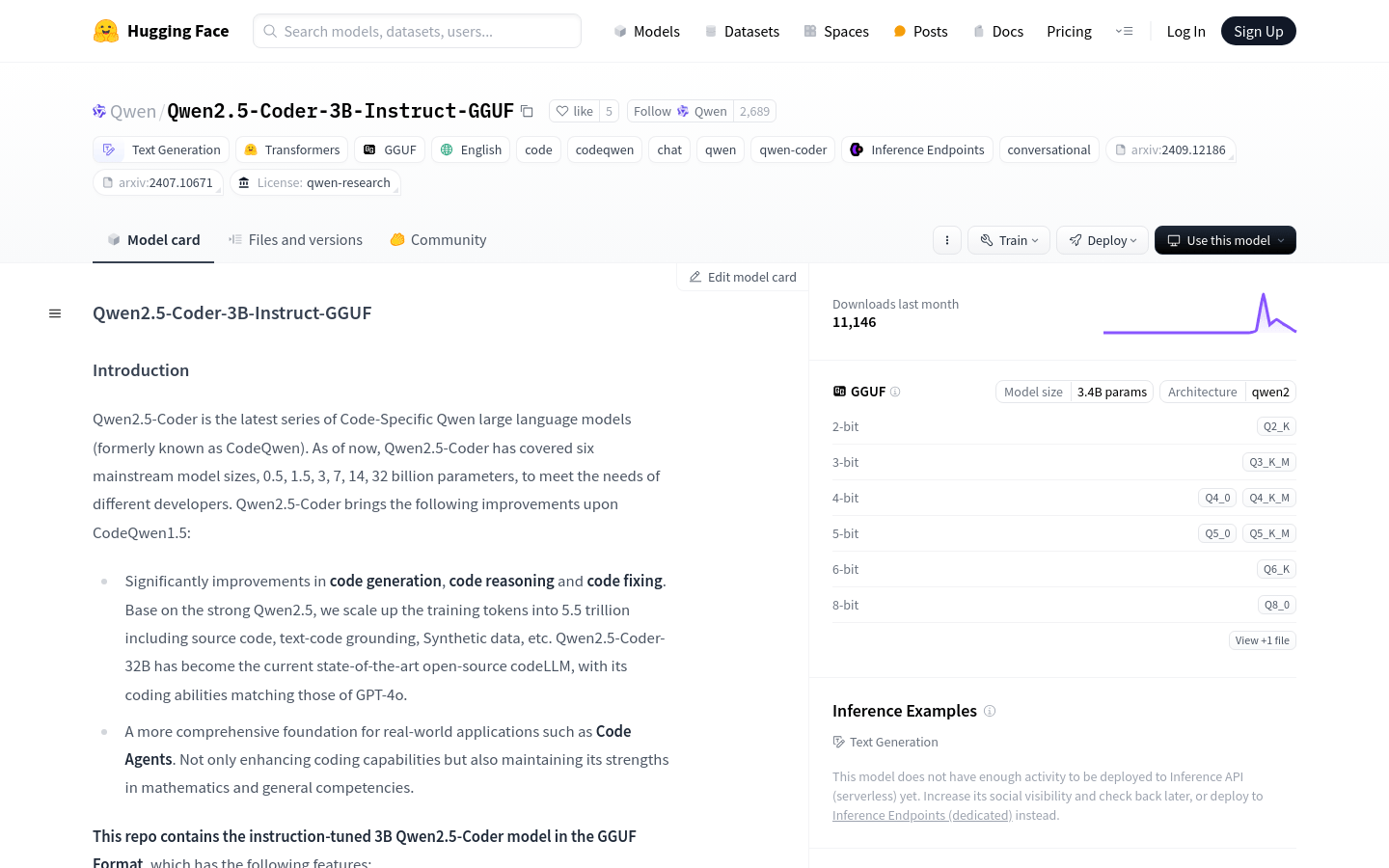

Qwen2.5-Coder-14BQwen2.5-Coder-14B是Qwen系列中专注于代码的大型语言模型,覆盖了0.5到32亿参数的不同模型尺寸,以满足不同开发者的需求。该模型在代...

Qwen2.5-Coder-14BQwen2.5-Coder-14B是Qwen系列中专注于代码的大型语言模型,覆盖了0.5到32亿参数的不同模型尺寸,以满足不同开发者的需求。该模型在代... -

SynnaSynna.Ai是一个无代码、AI驱动的工作流程构建器,主要优点包括自动化报告生成、简化操作流程以及保持数据更新。它提供了简单到复杂的工作流程编辑器,...

SynnaSynna.Ai是一个无代码、AI驱动的工作流程构建器,主要优点包括自动化报告生成、简化操作流程以及保持数据更新。它提供了简单到复杂的工作流程编辑器,... -

Mistral-Nemo-Instruct-2407Mistral-Nemo-Instruct-2407是由Mistral AI和NVIDIA联合训练的大型语言模型(LLM),是Mistral-Nemo...

Mistral-Nemo-Instruct-2407Mistral-Nemo-Instruct-2407是由Mistral AI和NVIDIA联合训练的大型语言模型(LLM),是Mistral-Nemo... -

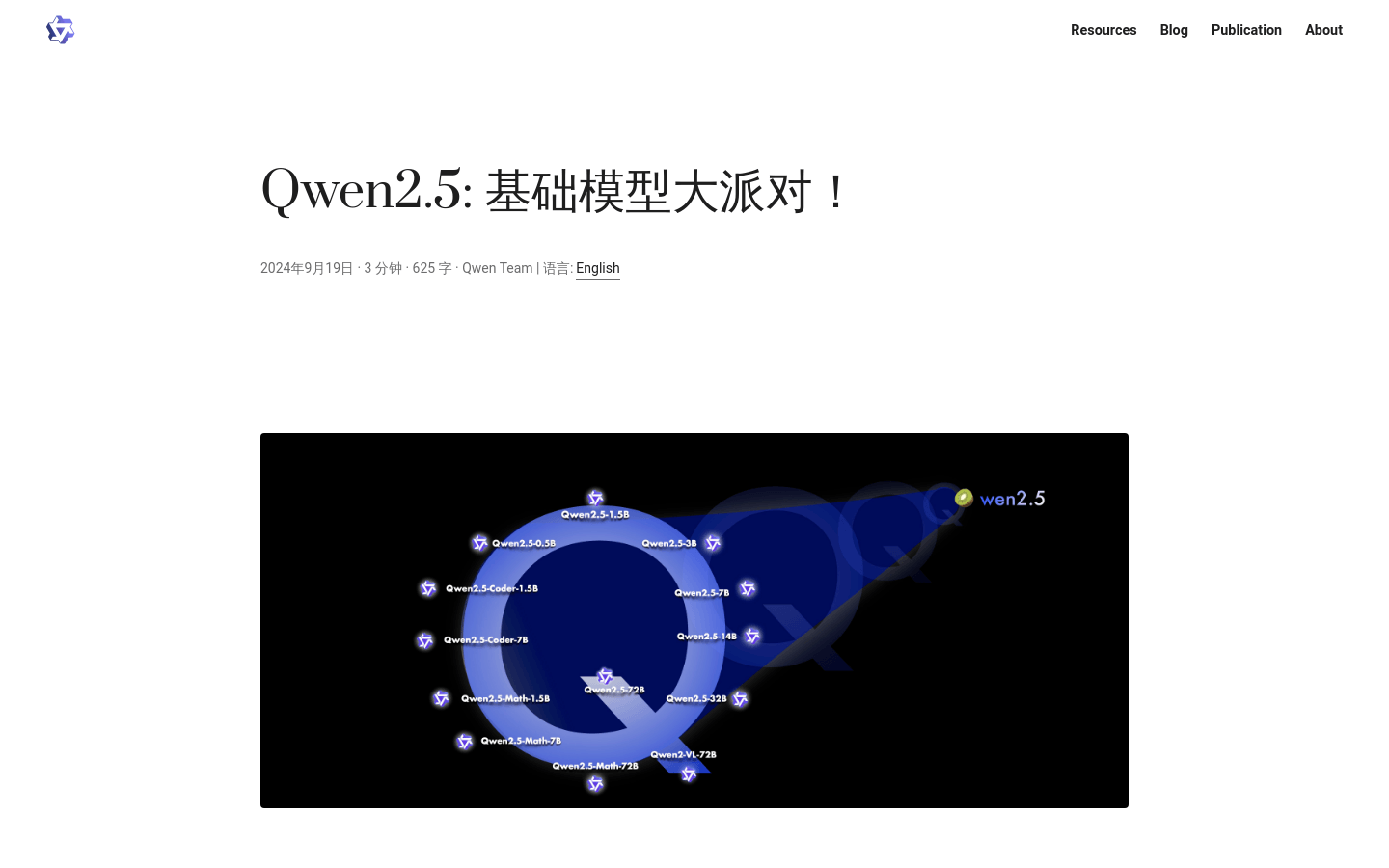

Qwen2.5Qwen2.5是一系列基于Qwen2语言模型构建的新型语言模型,包括通用语言模型Qwen2.5,以及专门针对编程的Qwen2.5-Coder和数学的Q...

Qwen2.5Qwen2.5是一系列基于Qwen2语言模型构建的新型语言模型,包括通用语言模型Qwen2.5,以及专门针对编程的Qwen2.5-Coder和数学的Q... -

Augment CodeAugment Code 是一款面向专业软件工程师的 AI 开发助手,旨在帮助开发者更好地管理和优化复杂的代码库。它通过智能的代码编辑建议、实时代码补...

Augment CodeAugment Code 是一款面向专业软件工程师的 AI 开发助手,旨在帮助开发者更好地管理和优化复杂的代码库。它通过智能的代码编辑建议、实时代码补... -

Jovu by AmplicationJovu是Amplication公司推出的AI驱动代码生成平台,旨在帮助开发者快速生成高质量的代码,提高开发效率。它通过AI技术理解用户需求,自动生成...

Jovu by AmplicationJovu是Amplication公司推出的AI驱动代码生成平台,旨在帮助开发者快速生成高质量的代码,提高开发效率。它通过AI技术理解用户需求,自动生成... -

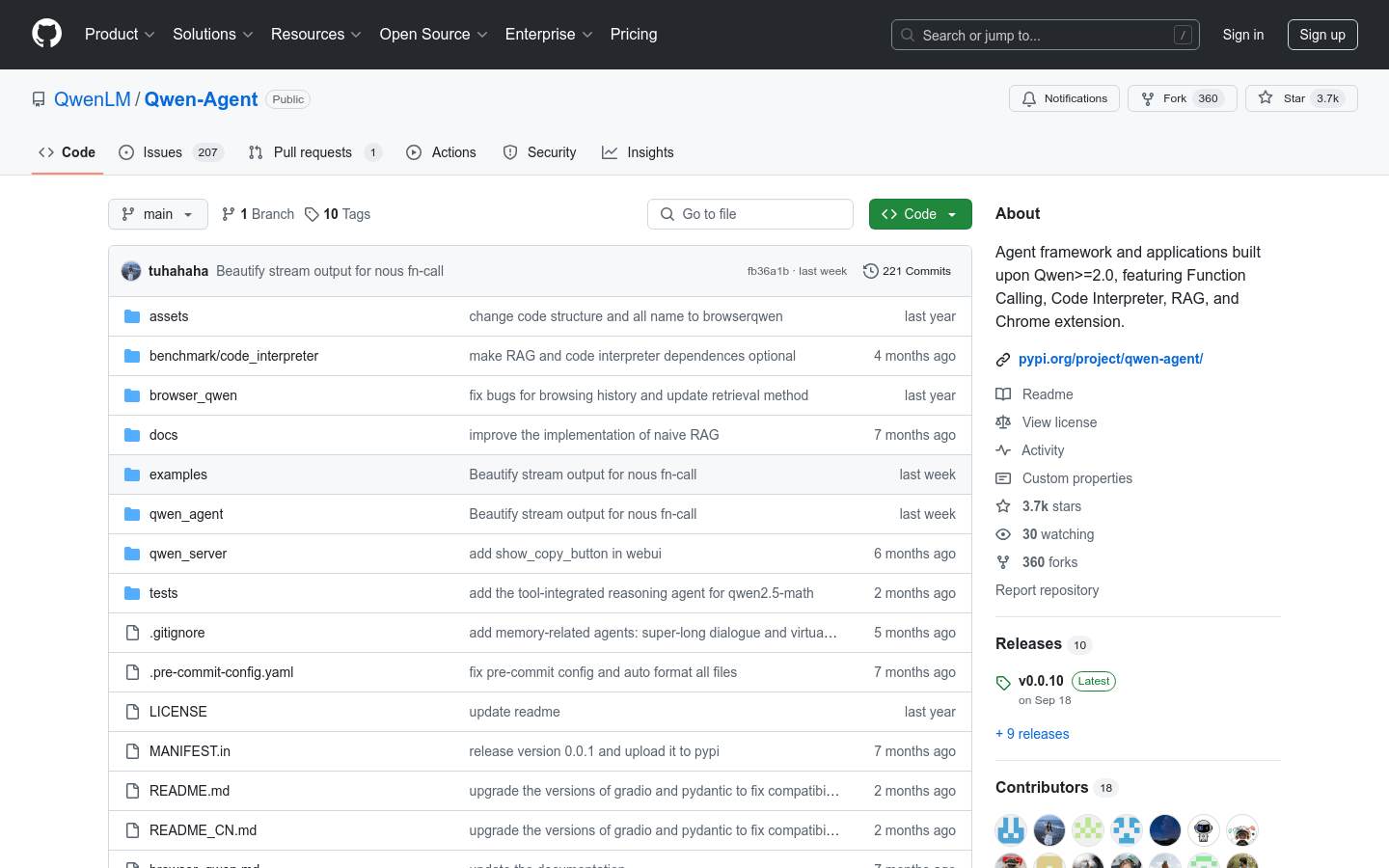

Qwen-AgentQwen-Agent是一个基于Qwen>=2.0构建的Agent框架,它具备指令遵循、工具使用、规划和记忆能力。该框架提供了如浏览器助手、代码解释器和...

Qwen-AgentQwen-Agent是一个基于Qwen>=2.0构建的Agent框架,它具备指令遵循、工具使用、规划和记忆能力。该框架提供了如浏览器助手、代码解释器和... -

Artifacts.runArtifacts.run 是一个基于 React 的代码分享平台,用户可以在平台上分享他们的 React 代码,并且在浏览器中实时运行。该平台简化了...

Artifacts.runArtifacts.run 是一个基于 React 的代码分享平台,用户可以在平台上分享他们的 React 代码,并且在浏览器中实时运行。该平台简化了... -

We0We0是一款强大的桌面客户端工具,专注于帮助开发者快速生成和部署AI驱动的应用程序。它支持多种现代开发框架,如Vue、React、Next.js、Py...

We0We0是一款强大的桌面客户端工具,专注于帮助开发者快速生成和部署AI驱动的应用程序。它支持多种现代开发框架,如Vue、React、Next.js、Py...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

ImageCreator

ImageCreator是一款免费的Photoshop插件,它允许您在Photoshop中使用稳定扩散、LoRA、ControlNet和生成填充等功能...

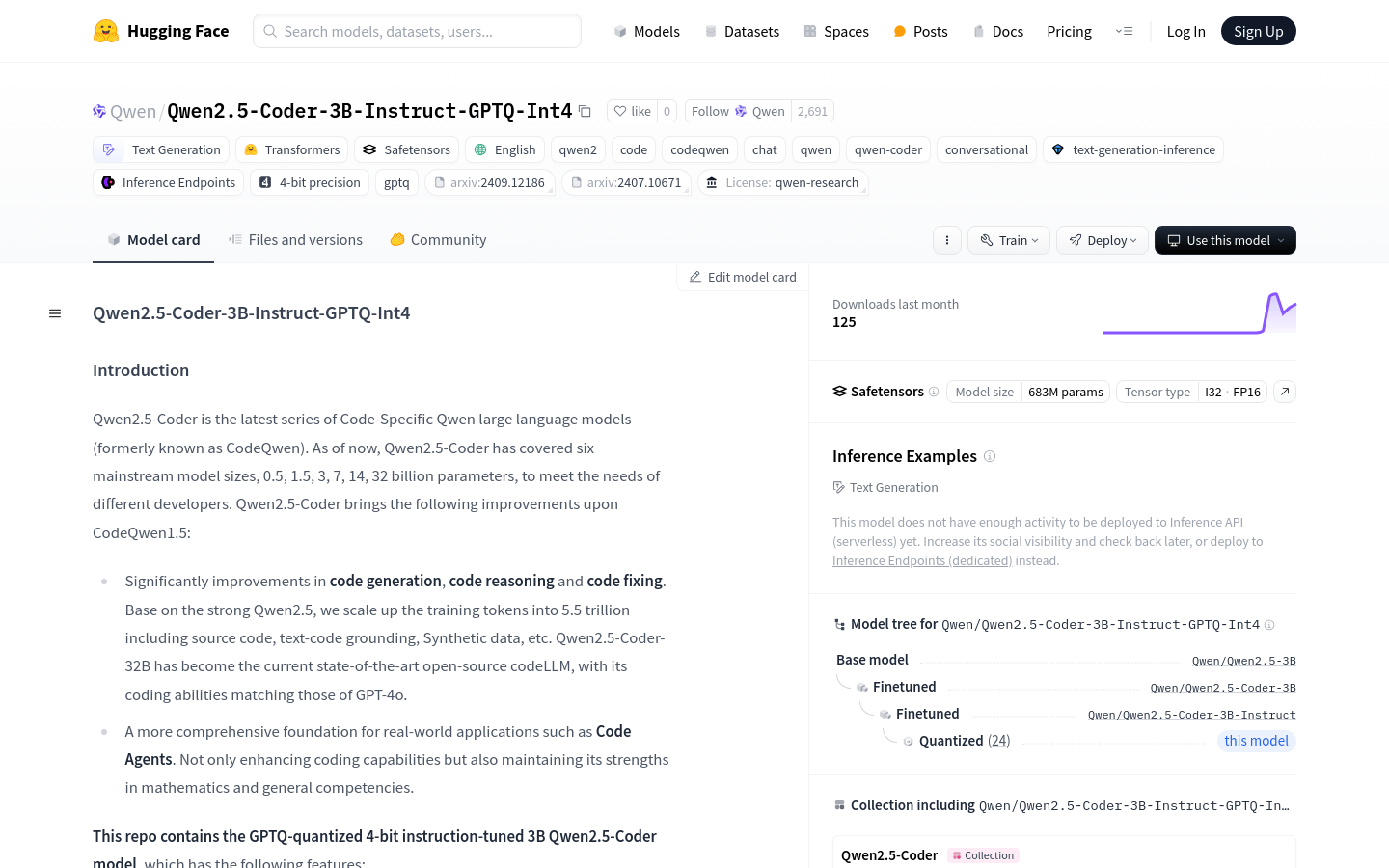

Qwen2.5-Coder-3B-Instruct-GPTQ-Int4

Qwen2.5-Coder是Qwen大型语言模型的最新系列,专为代码生成、推理和修复而设计。该模型基于Qwen2.5,扩展了训练令牌至5.5万亿,包括...

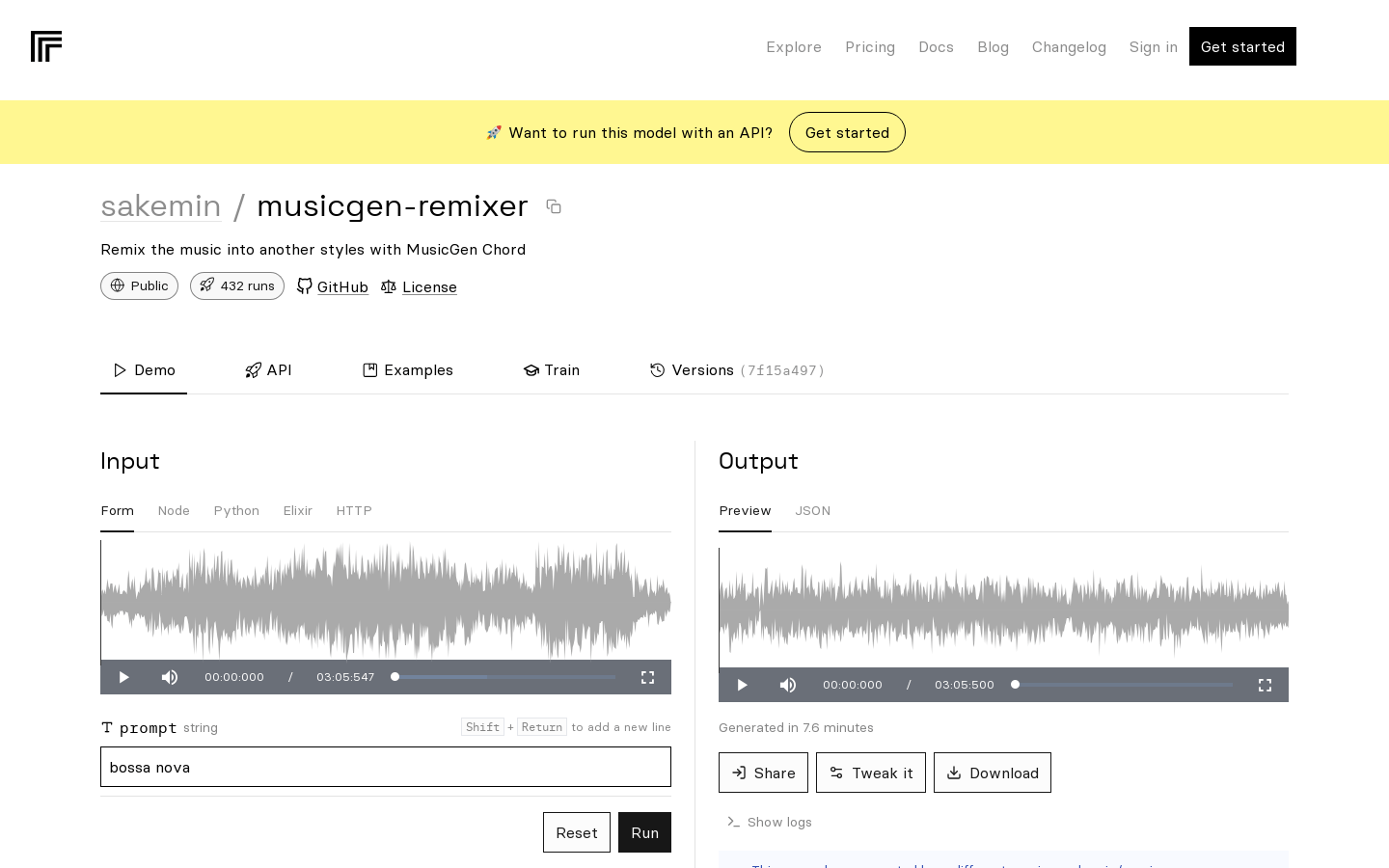

MusicGen Remixer

MusicGen Remixer是一个基于 MusicGen Chord 的音乐重置模型。它可以接收音频文件作为输入,并使用 MusicGen Cho...

Writerly

Writerly是一款SaaS平台,提供无代码AI生产力工具,帮助企业扩大销售、营销、电子商务、用户体验、产品等方面的规模。通过使用智能品牌人设,Wr...

easywithai.com

Easy With AI是一个拥有互联网上最大的AI工具和资源收藏的平台。您可以在50多个不同的类别中查找和搜索AI工具。Easy With AI为各...

百度GBI

百度GBI是一款依托大模型对话交互的商业分析助手,能够实现查询、绘图、归因、预测、洞察、总结等全链路数据分析任务,无需编写SQL代码,简化了数据分析流...

最新文章

1

2

3

4

5

6

7

8

9

10