下一个

PearAI

相关AI工具集

-

Graphite ReviewerGraphite Reviewer是一个AI代码审查工具,它通过即时反馈帮助团队提高代码审查的效率和质量。该工具利用代码库感知AI,自动检测代码中的b...

Graphite ReviewerGraphite Reviewer是一个AI代码审查工具,它通过即时反馈帮助团队提高代码审查的效率和质量。该工具利用代码库感知AI,自动检测代码中的b... -

Codestral 25.01Codestral 25.01是由Mistral AI推出的一款先进的编程辅助模型,它代表了当前编程模型领域的前沿技术。该模型具有轻量级、快速以及精通...

Codestral 25.01Codestral 25.01是由Mistral AI推出的一款先进的编程辅助模型,它代表了当前编程模型领域的前沿技术。该模型具有轻量级、快速以及精通... -

Lune AILune AI是一个社区驱动的专家级大型语言模型(LLMs)市场,由开发者在技术主题上创建,以超越单独的AI模型。它通过集成各种技术知识源,如GitH...

Lune AILune AI是一个社区驱动的专家级大型语言模型(LLMs)市场,由开发者在技术主题上创建,以超越单独的AI模型。它通过集成各种技术知识源,如GitH... -

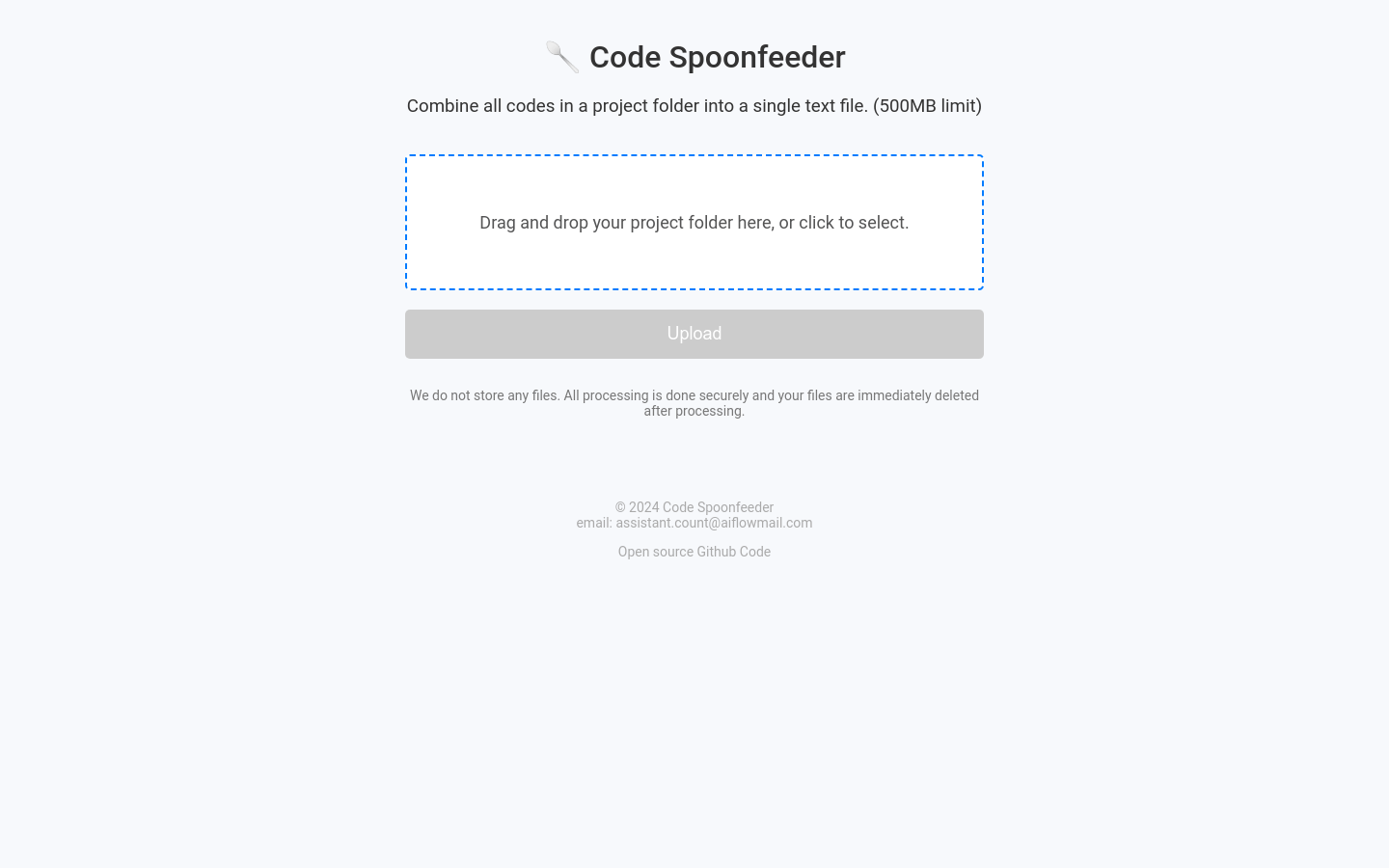

Code SpoonfeederCode Spoonfeeder是一个在线工具,它允许用户将一个项目文件夹中的所有代码文件合并成一个单一的文本文件,方便代码的查看和管理。这个工具对于...

Code SpoonfeederCode Spoonfeeder是一个在线工具,它允许用户将一个项目文件夹中的所有代码文件合并成一个单一的文本文件,方便代码的查看和管理。这个工具对于... -

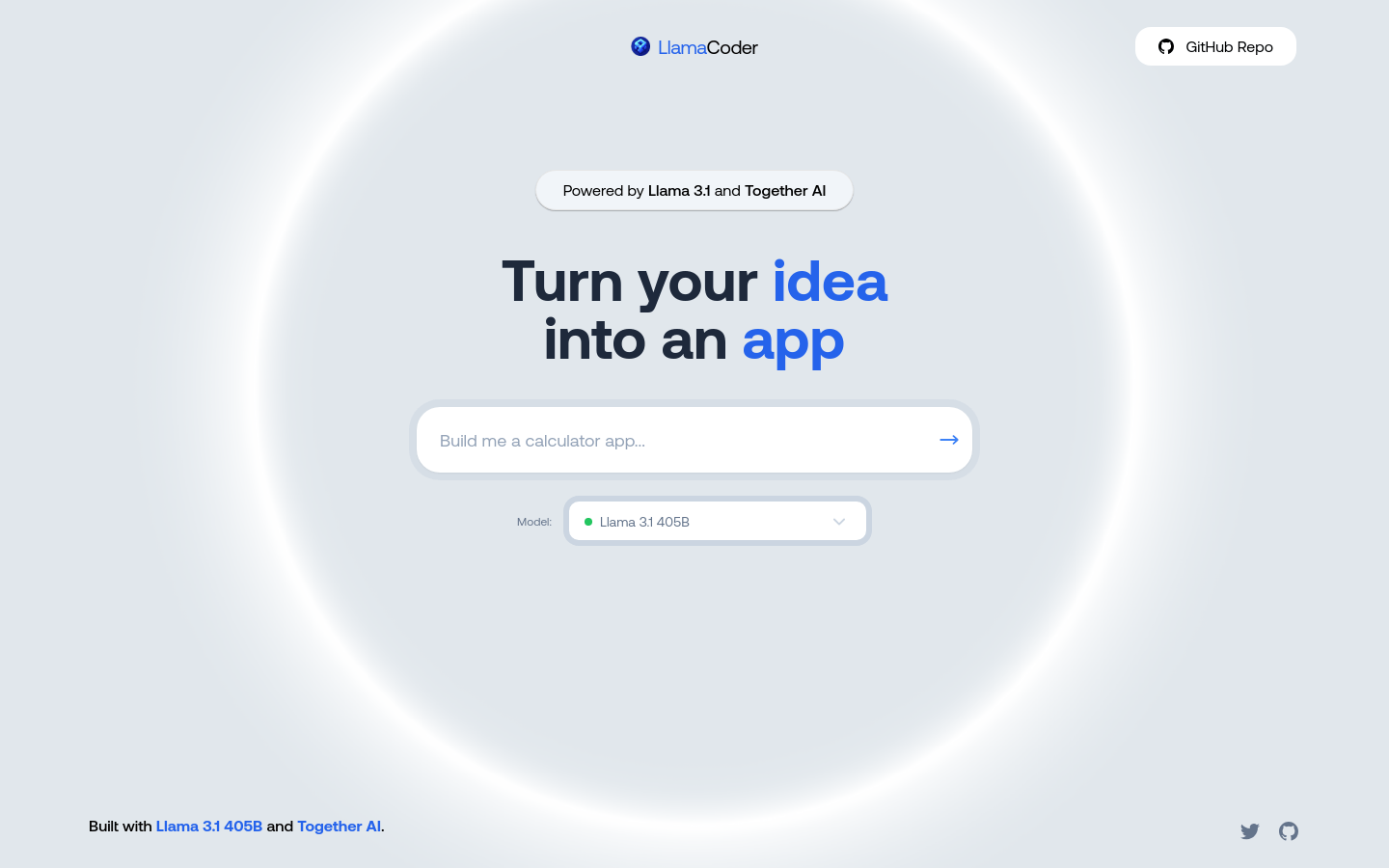

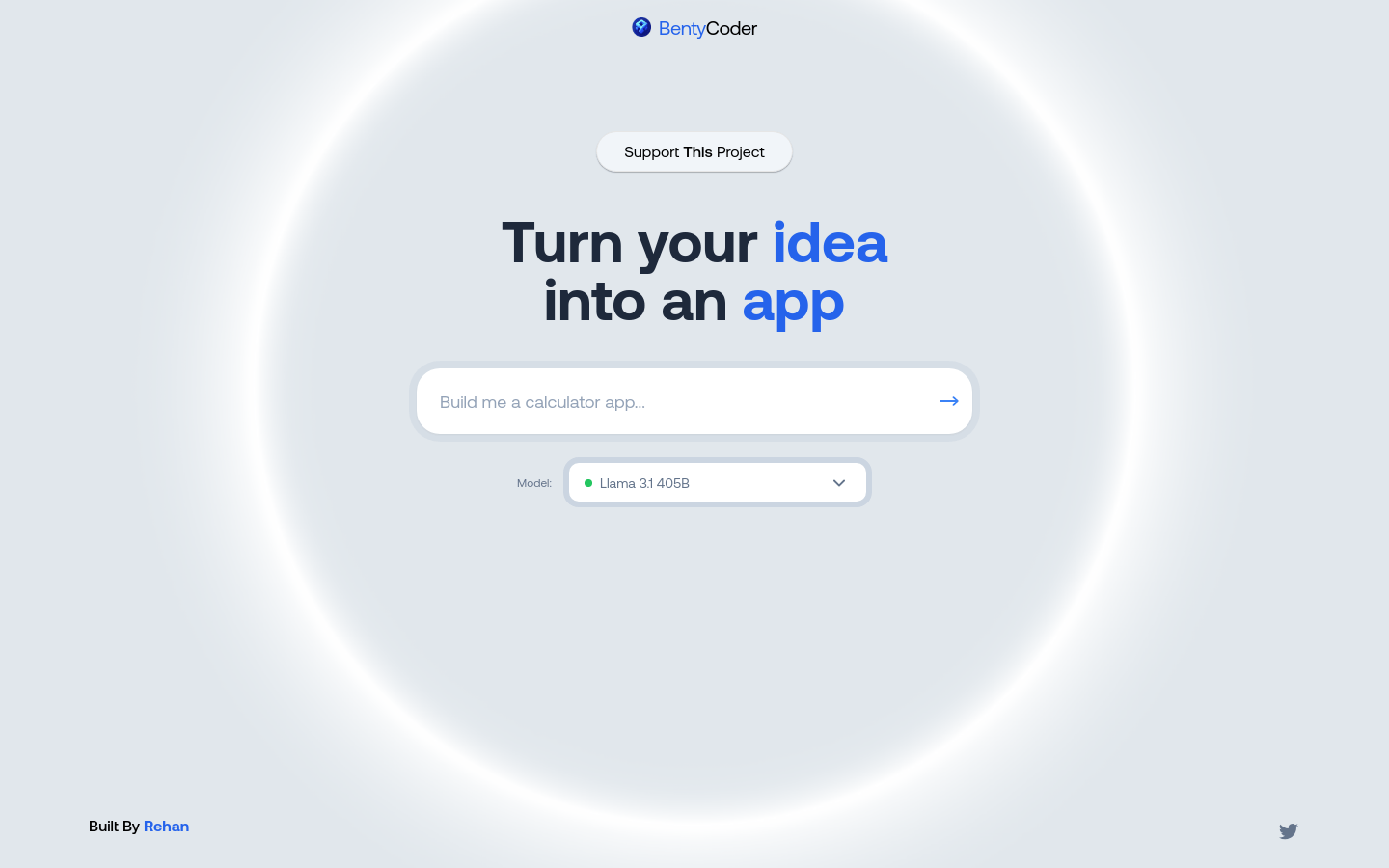

Benty CoderBenty Coder是一个AI代码生成器,能够根据用户的想法快速生成应用程序代码。它基于Llama 3.1 405B模型,具有高度的智能和灵活性,能...

Benty CoderBenty Coder是一个AI代码生成器,能够根据用户的想法快速生成应用程序代码。它基于Llama 3.1 405B模型,具有高度的智能和灵活性,能... -

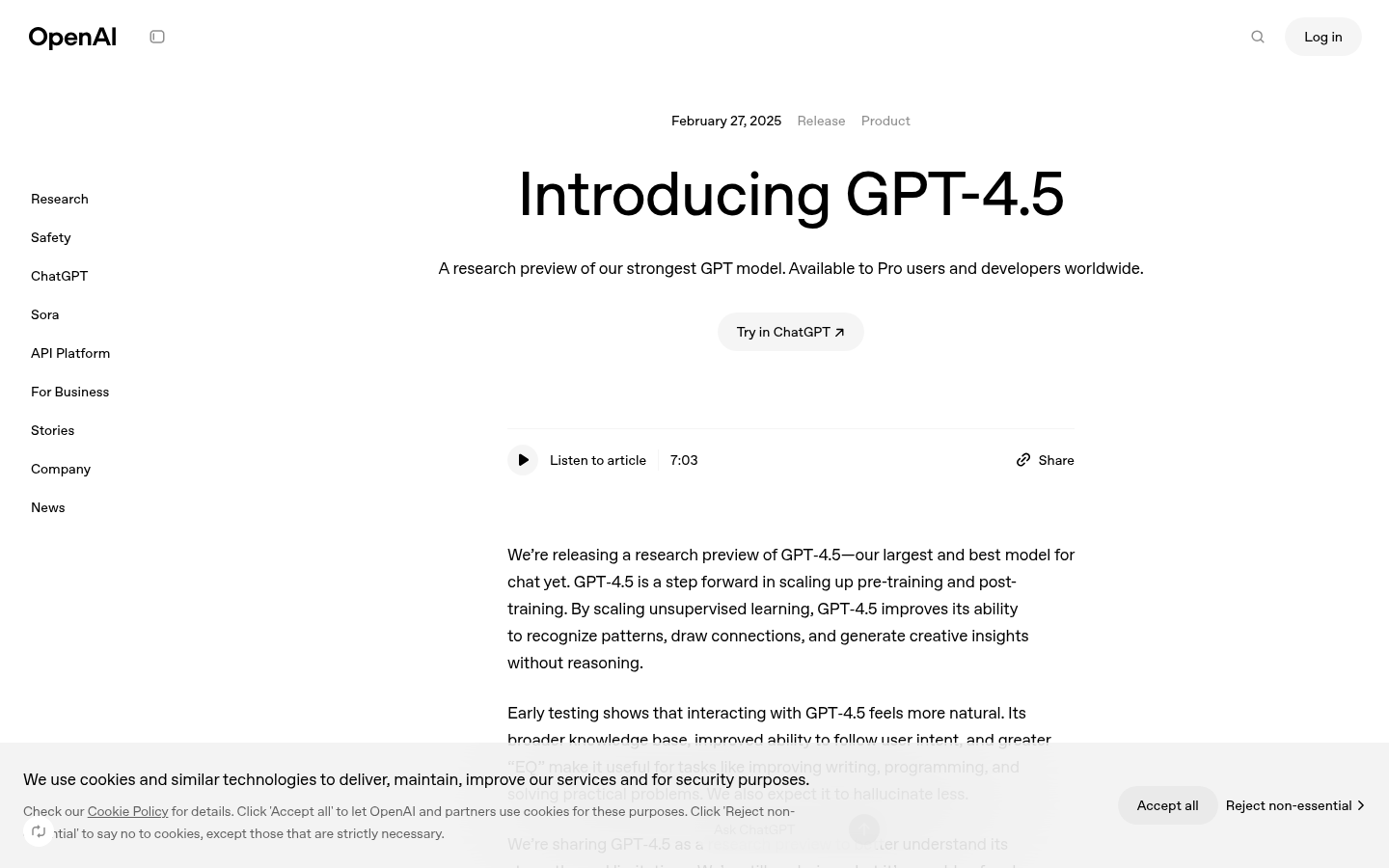

GPT-4.5GPT-4.5是OpenAI发布的最新语言模型,代表了当前无监督学习技术的前沿水平。该模型通过大规模计算和数据训练,提升了对世界知识的理解和模式识别能...

GPT-4.5GPT-4.5是OpenAI发布的最新语言模型,代表了当前无监督学习技术的前沿水平。该模型通过大规模计算和数据训练,提升了对世界知识的理解和模式识别能... -

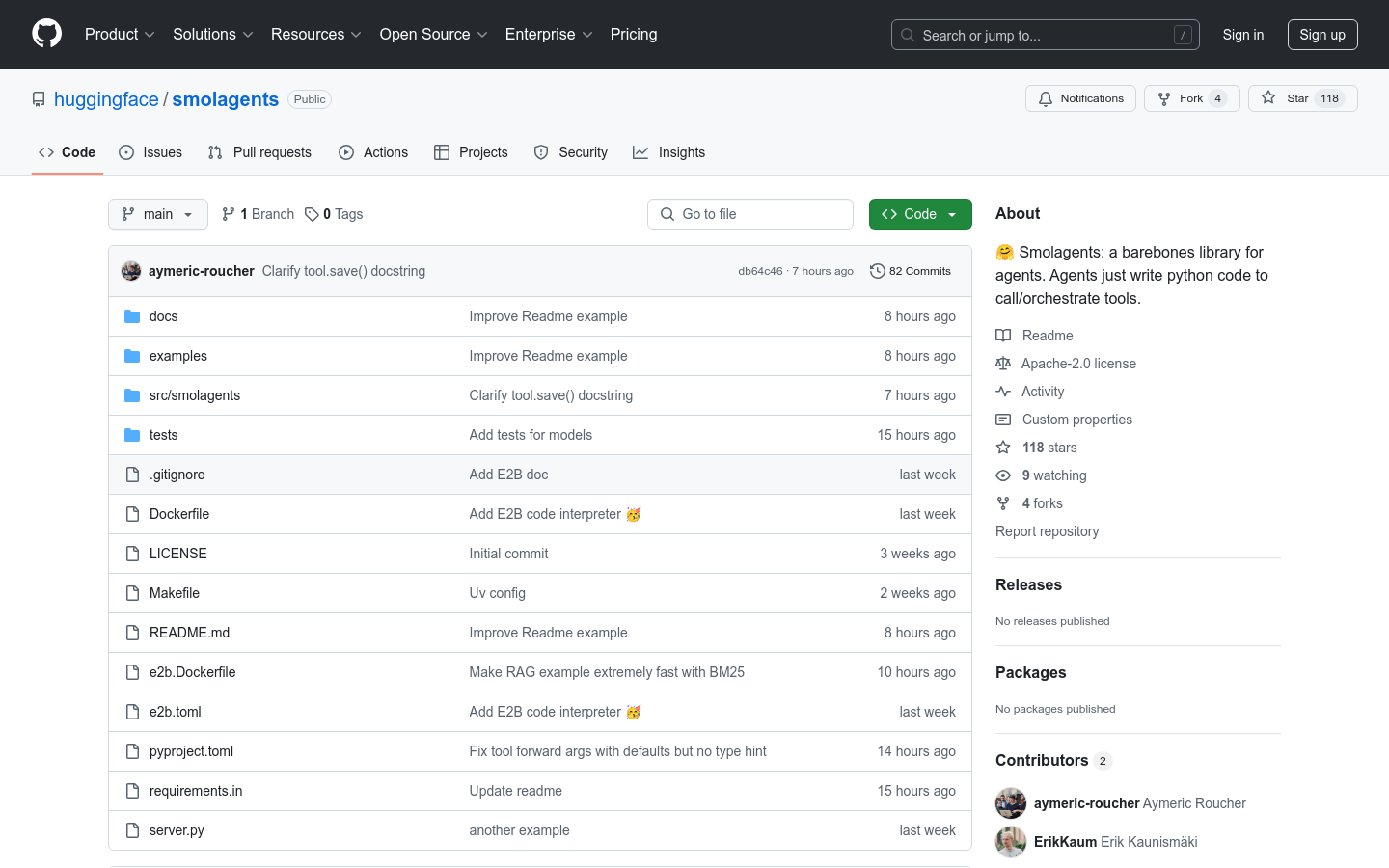

SmolagentsSmolagents是一个轻量级的库,允许用户以几行代码运行强大的智能代理。它以简洁性为特点,支持任何语言模型(LLM),包括Hugging Face...

SmolagentsSmolagents是一个轻量级的库,允许用户以几行代码运行强大的智能代理。它以简洁性为特点,支持任何语言模型(LLM),包括Hugging Face... -

SWE-LancerSWE-Lancer 是由 OpenAI 推出的一个基准测试,旨在评估前沿语言模型在真实世界中的自由软件工程任务中的表现。该基准测试涵盖了从 50 美...

SWE-LancerSWE-Lancer 是由 OpenAI 推出的一个基准测试,旨在评估前沿语言模型在真实世界中的自由软件工程任务中的表现。该基准测试涵盖了从 50 美... -

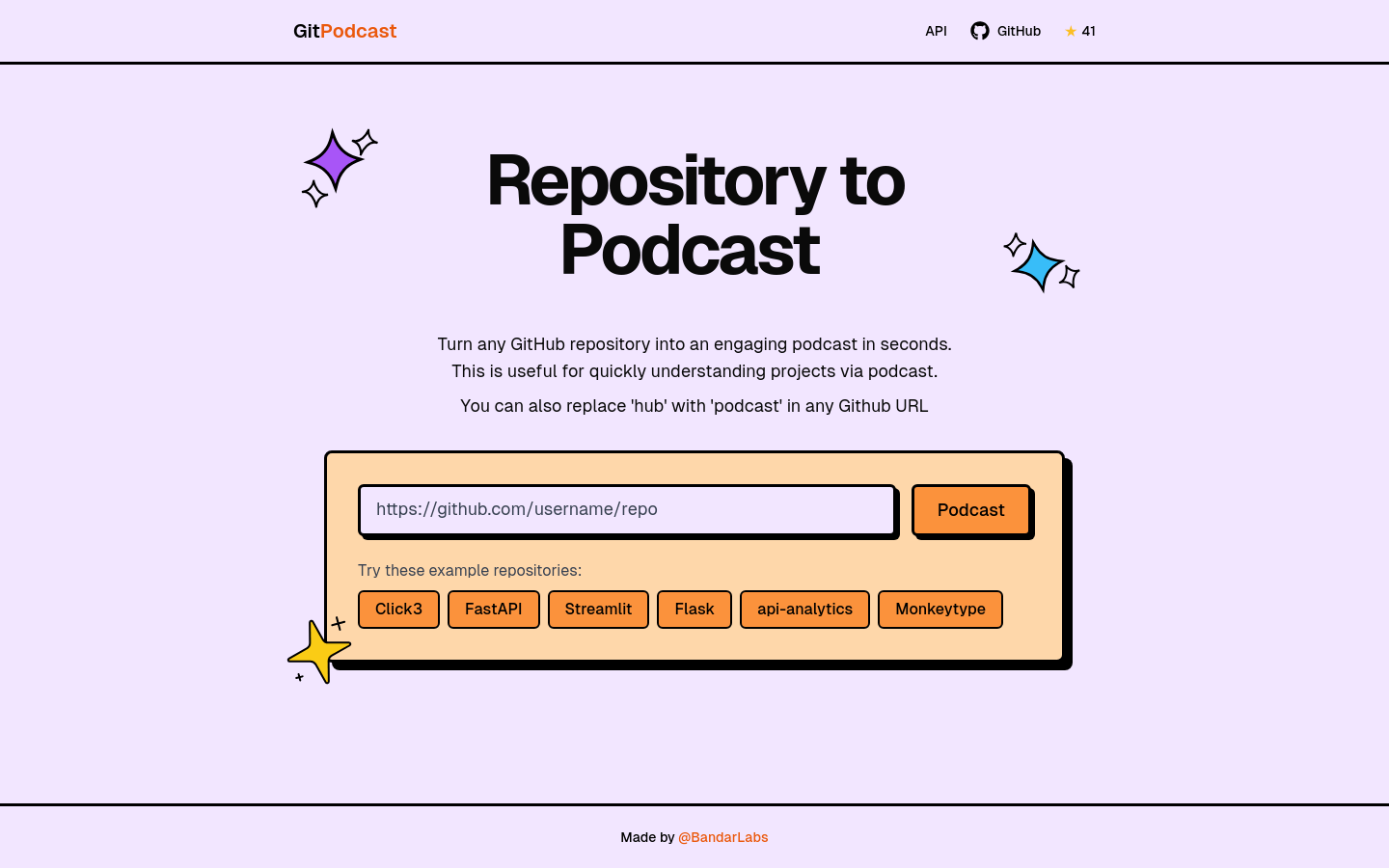

GitPodcastGitPodcast是一个创新的在线工具,它允许用户将GitHub上的任何代码仓库转换成播客形式,从而快速理解项目。这种形式特别适合开发者和对项目感兴...

GitPodcastGitPodcast是一个创新的在线工具,它允许用户将GitHub上的任何代码仓库转换成播客形式,从而快速理解项目。这种形式特别适合开发者和对项目感兴... -

WordwareWordware是一个集成了自然语言编程(NLP)的在线开发环境,它允许用户通过自然语言指令来开发、迭代和部署AI代理。Wordware结合了软件的最...

WordwareWordware是一个集成了自然语言编程(NLP)的在线开发环境,它允许用户通过自然语言指令来开发、迭代和部署AI代理。Wordware结合了软件的最... -

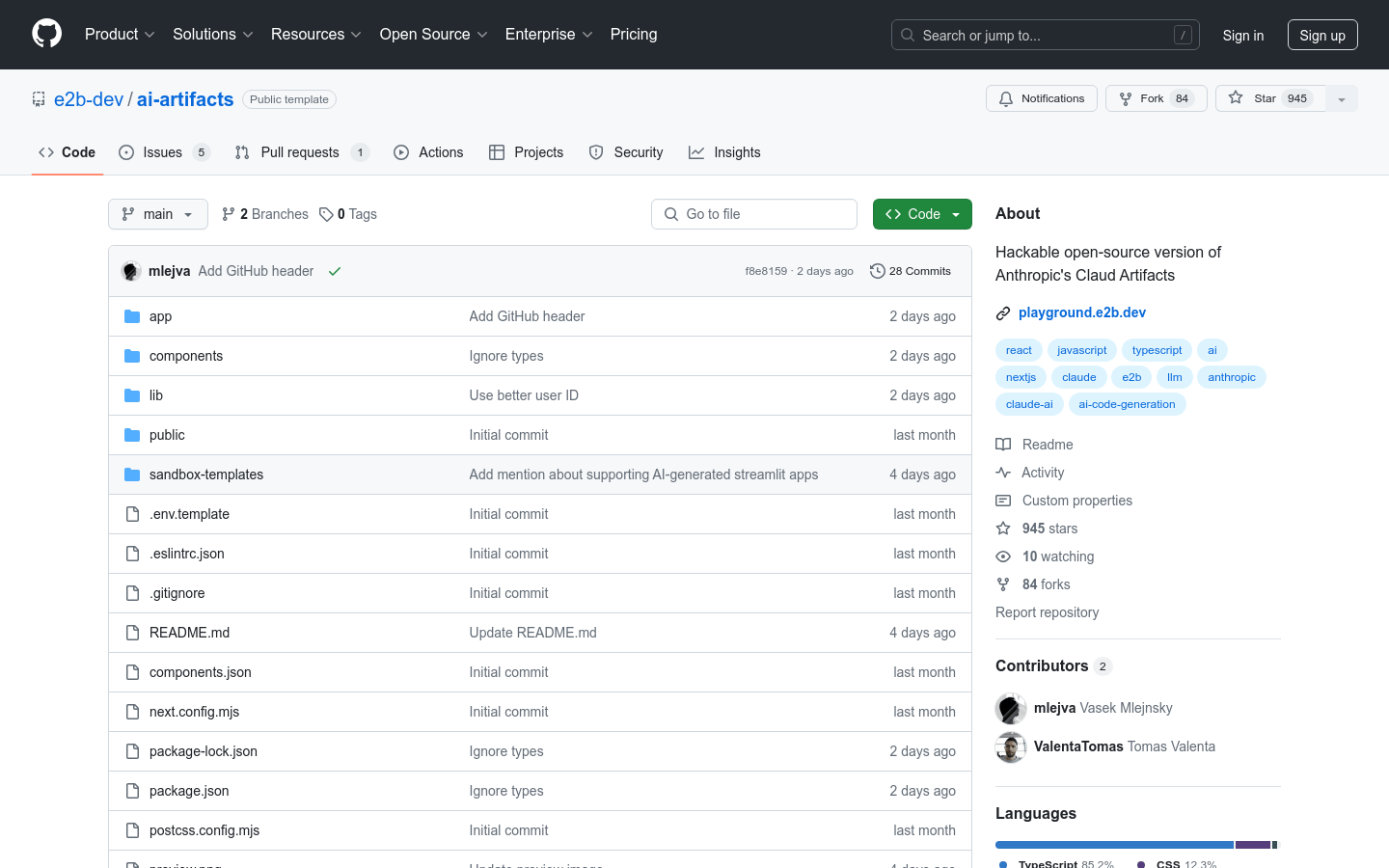

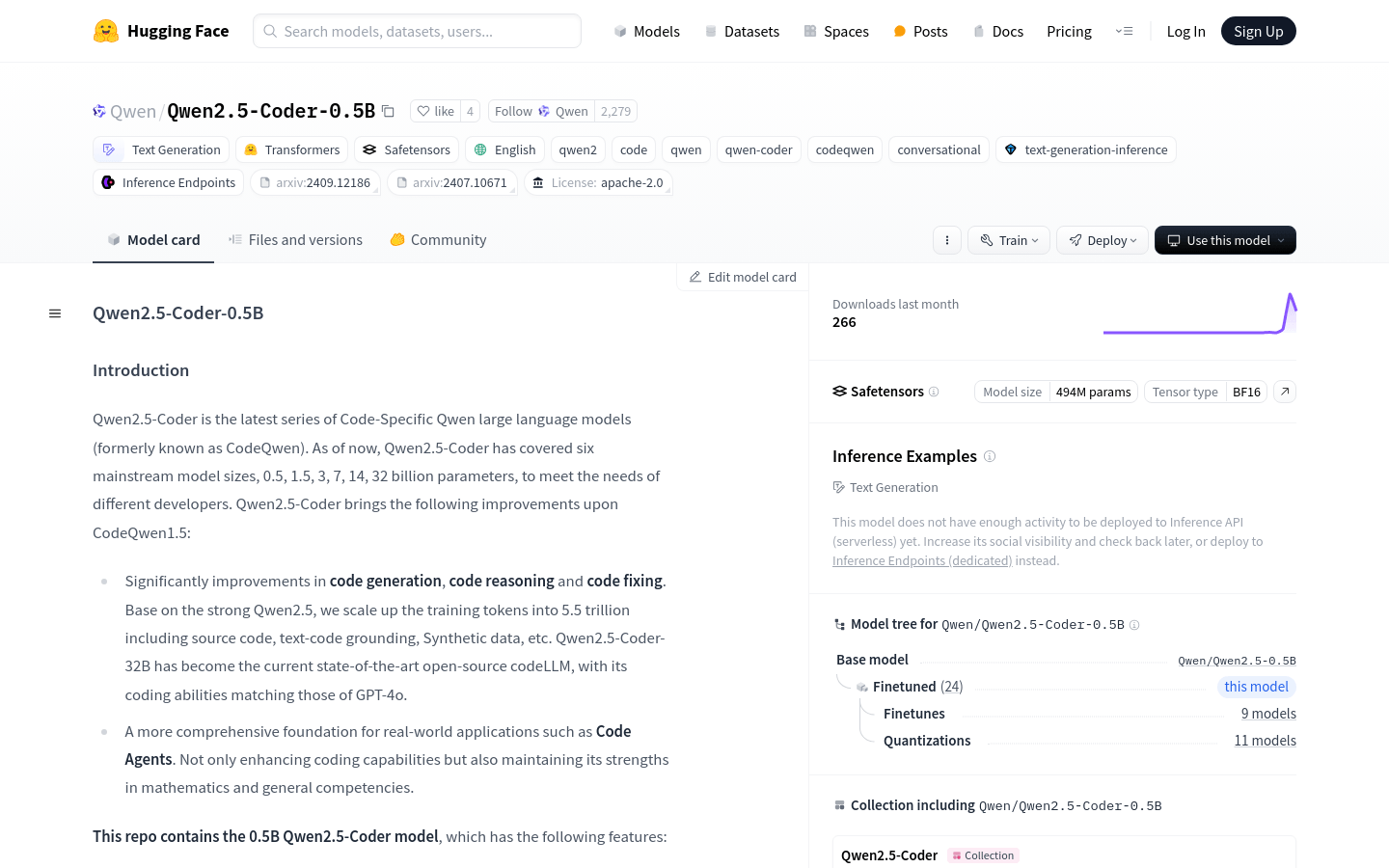

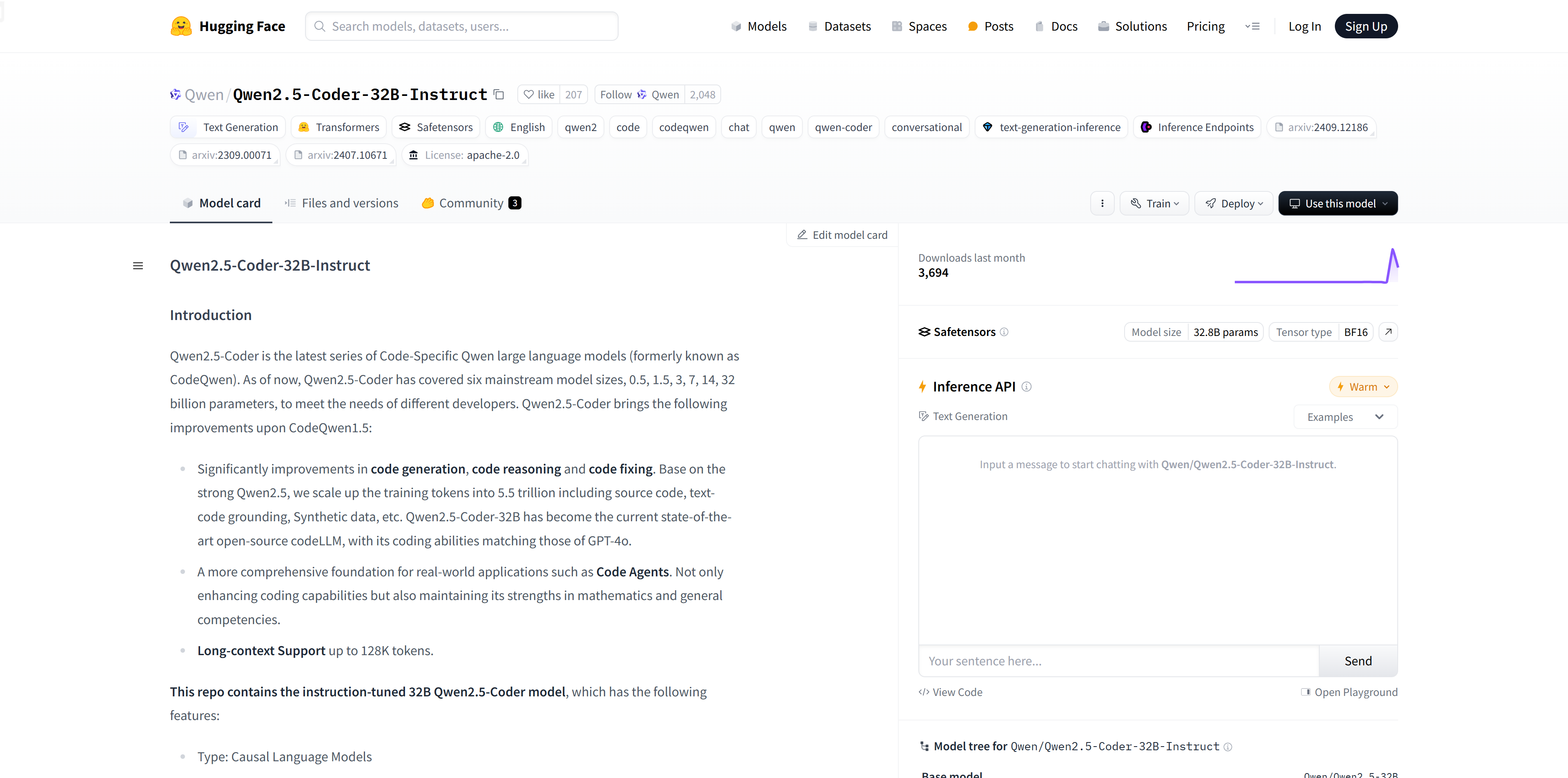

Qwen2.5-Coder-32B-InstructQwen2.5-Coder是一系列专为代码生成设计的Qwen大型语言模型,包含0.5、1.5、3、7、14、32亿参数的六种主流模型尺寸,以满足不同开...

Qwen2.5-Coder-32B-InstructQwen2.5-Coder是一系列专为代码生成设计的Qwen大型语言模型,包含0.5、1.5、3、7、14、32亿参数的六种主流模型尺寸,以满足不同开... -

小艺小艺是华为推出的智能助手,集成了自然语言处理和机器学习技术,能够提供聊天、写作、编程、翻译等多种功能。它基于深度学习模型,能够理解用户的问题并给出准确...

小艺小艺是华为推出的智能助手,集成了自然语言处理和机器学习技术,能够提供聊天、写作、编程、翻译等多种功能。它基于深度学习模型,能够理解用户的问题并给出准确...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

InboxDone

InboxDone 是一家专注于电子邮件管理的虚拟执行助理服务,旨在通过专业的助理团队帮助客户回复电子邮件和管理日历,从而释放客户的时间,让他们能够专...

wevideo

Wevideo是用于学校,企业和企业家的领先的在线视频编辑平台。易于使用的工具可让您创建具有专业结果的惊人多媒体项目。立即开始免费使用#1视频编辑器!...

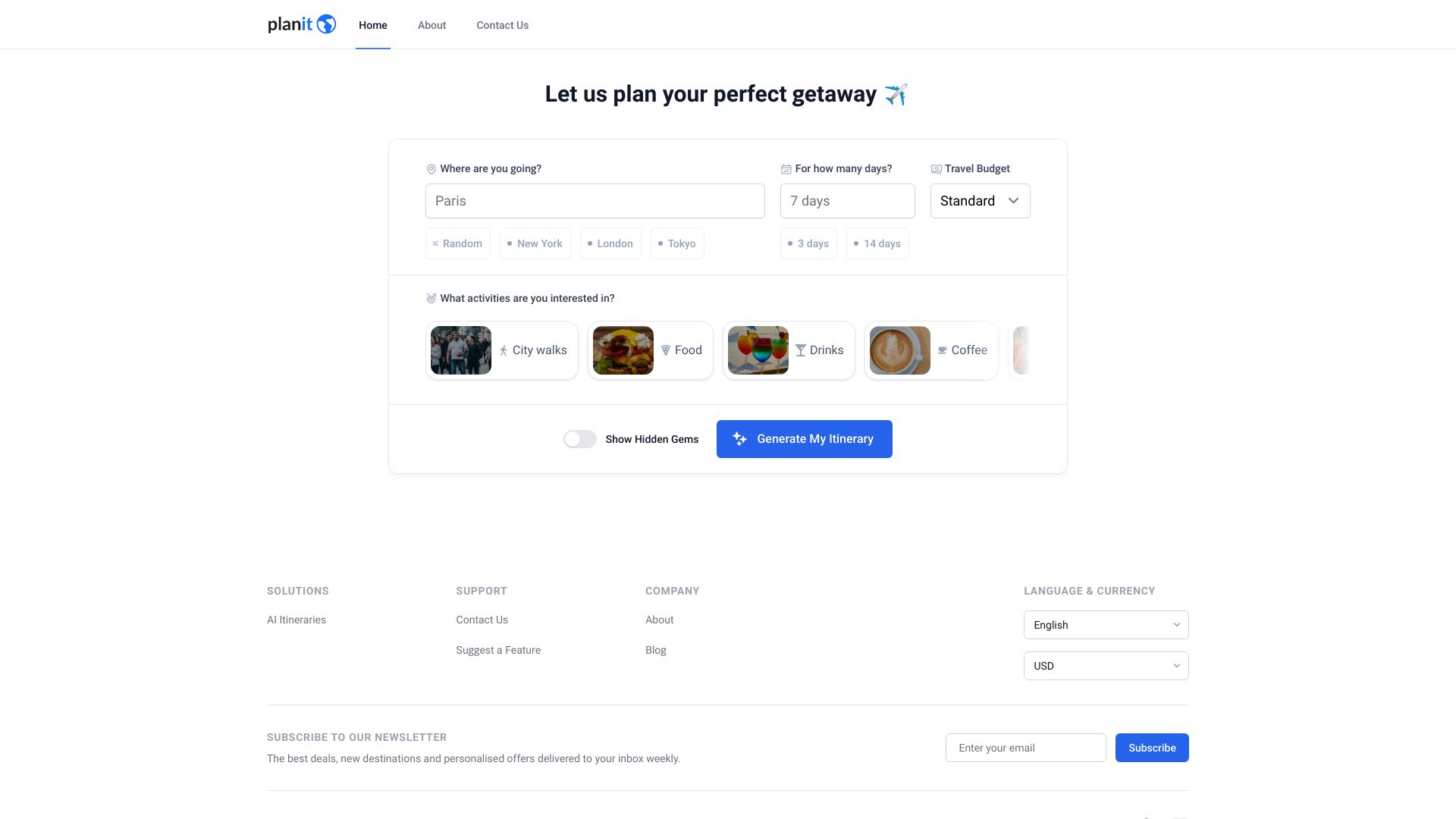

Planit Earth

Planit Earth是一款AI驱动的旅行规划工具,帮助用户生成下一个目的地的完美行程。它可以根据用户选择的目的地、旅行天数和预算,自动生成包含景点...

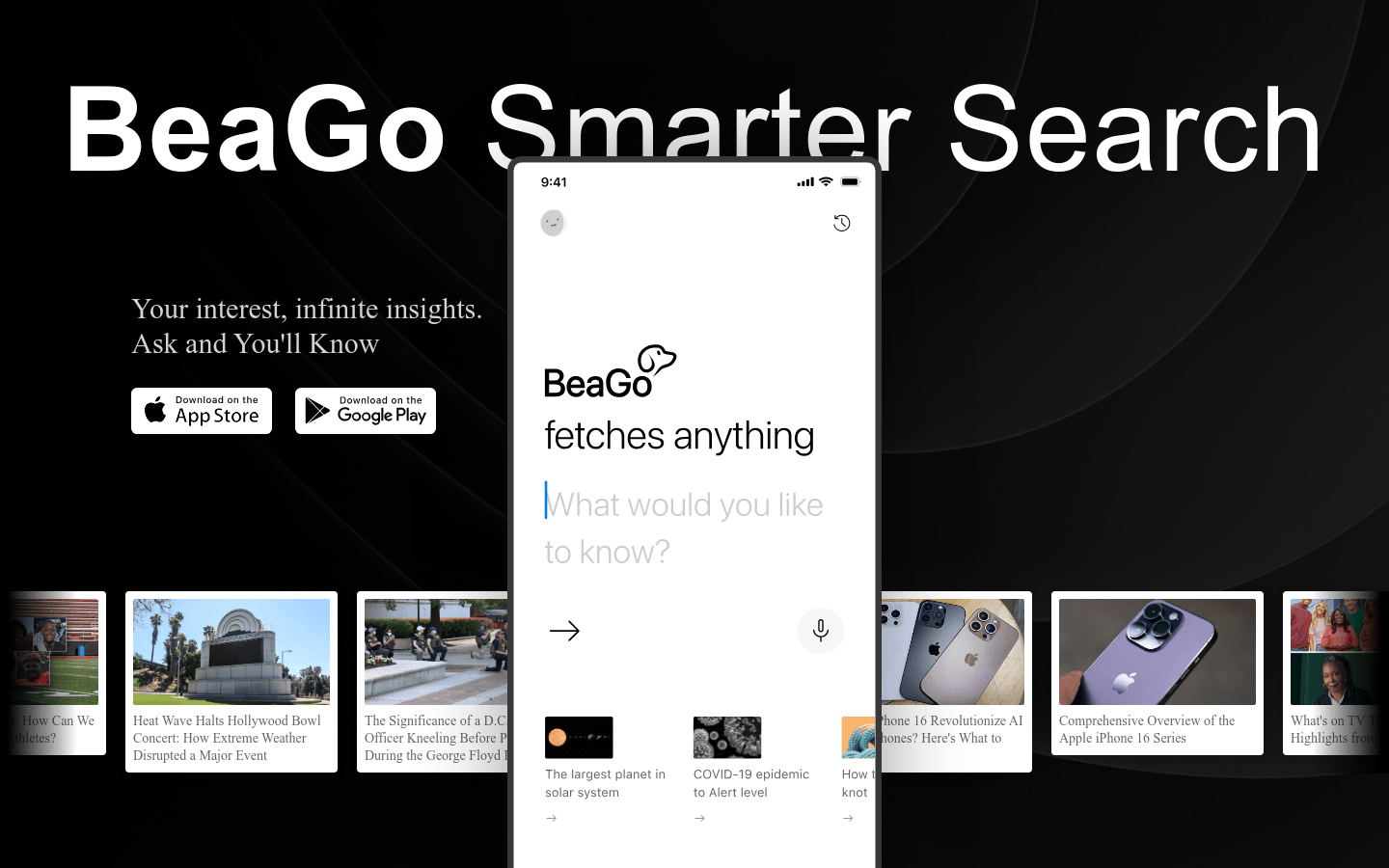

BeaGo

BeaGo是一款由Rhymes Technology Inc开发的智能搜索应用,它利用先进的AI技术,能够理解用户的需求,快速找到可靠和高质量的答案。...

adima ai image upscaler

使用Adima -AI -AI Image Upscaler软件转换您的图像。 Adima功能强大的工具使用高级AI算法来高档图像,最多是其原始尺寸的...

social studio

通过社交工作室,使您的Instagram内容创建比以往任何时候都更容易。使用此AI助手,您可以在几分钟内生成内容,设计帖子,并将其直接安排到Insta...

最新文章

1

2

3

4

5

6

7

8

9

10