相关AI工具集

-

BestBlogs.devBestBlogs.dev 是一个专注于编程、人工智能、产品设计、商业科技及个人成长领域的阅读平台。它通过先进的语言模型,为开发者提供智能摘要、精准评...

BestBlogs.devBestBlogs.dev 是一个专注于编程、人工智能、产品设计、商业科技及个人成长领域的阅读平台。它通过先进的语言模型,为开发者提供智能摘要、精准评... -

Yi-CoderYi-Coder是一系列开源的代码大型语言模型(LLMs),在少于100亿参数的情况下提供最先进的编码性能。它有两种尺寸—1.5B和9B参数—提供基础...

Yi-CoderYi-Coder是一系列开源的代码大型语言模型(LLMs),在少于100亿参数的情况下提供最先进的编码性能。它有两种尺寸—1.5B和9B参数—提供基础... -

Aviator AgentsAviator Agents 是一款专注于代码迁移的编程工具。它通过集成LLM技术,能够直接与GitHub连接,支持多种模型,如Open-AI o1、...

Aviator AgentsAviator Agents 是一款专注于代码迁移的编程工具。它通过集成LLM技术,能够直接与GitHub连接,支持多种模型,如Open-AI o1、... -

UsermavenUsermaven是一个简单易用且功能强大的网站和产品分析工具,专为市场营销人员和产品专业人士设计。它通过自动捕获所有事件来提供精确的追踪,无需依赖开...

UsermavenUsermaven是一个简单易用且功能强大的网站和产品分析工具,专为市场营销人员和产品专业人士设计。它通过自动捕获所有事件来提供精确的追踪,无需依赖开... -

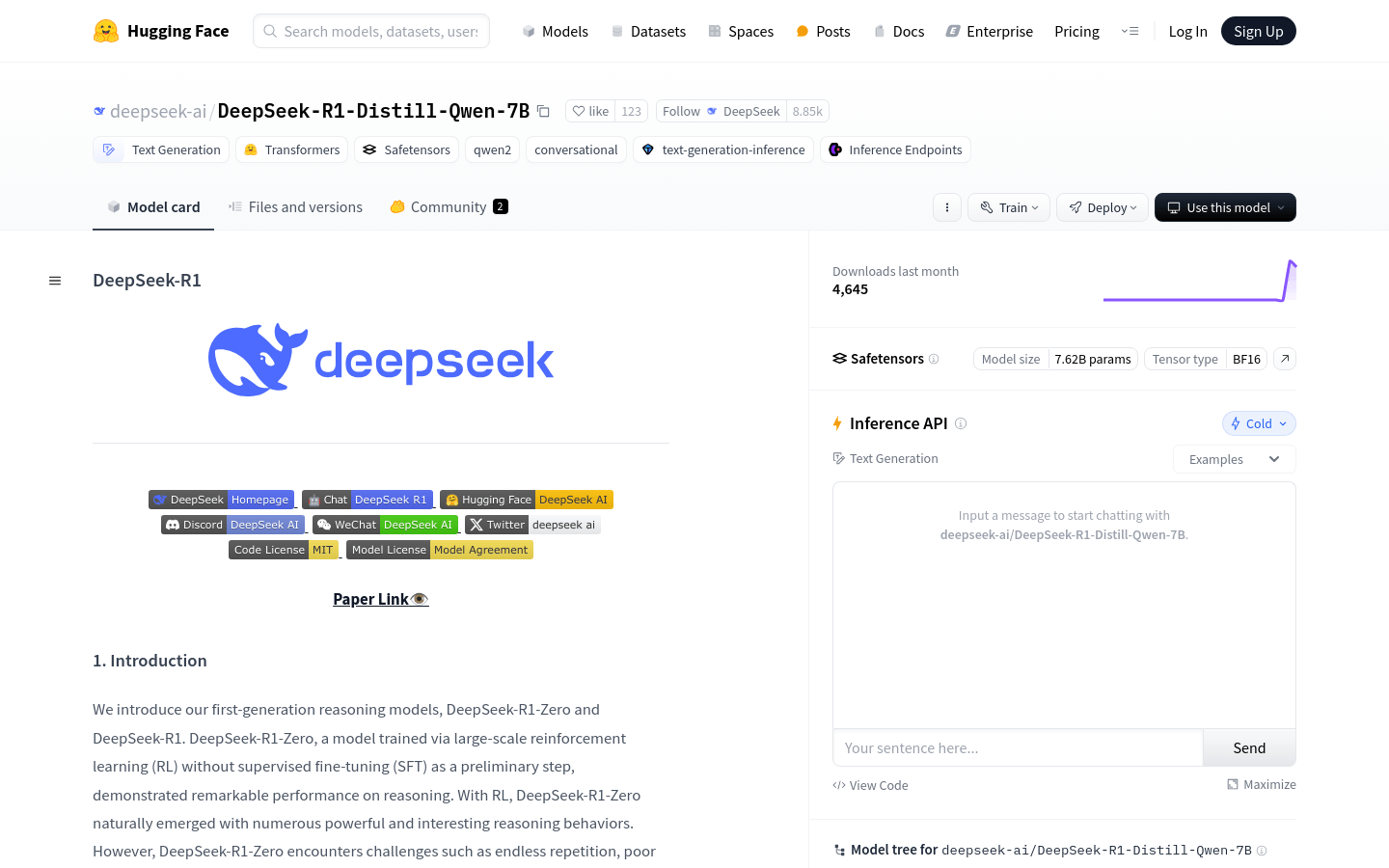

DeepSeek-R1-Distill-Qwen-7BDeepSeek-R1-Distill-Qwen-7B 是一个经过强化学习优化的推理模型,基于 Qwen-7B 进行了蒸馏优化。它在数学、代码和推理任...

DeepSeek-R1-Distill-Qwen-7BDeepSeek-R1-Distill-Qwen-7B 是一个经过强化学习优化的推理模型,基于 Qwen-7B 进行了蒸馏优化。它在数学、代码和推理任... -

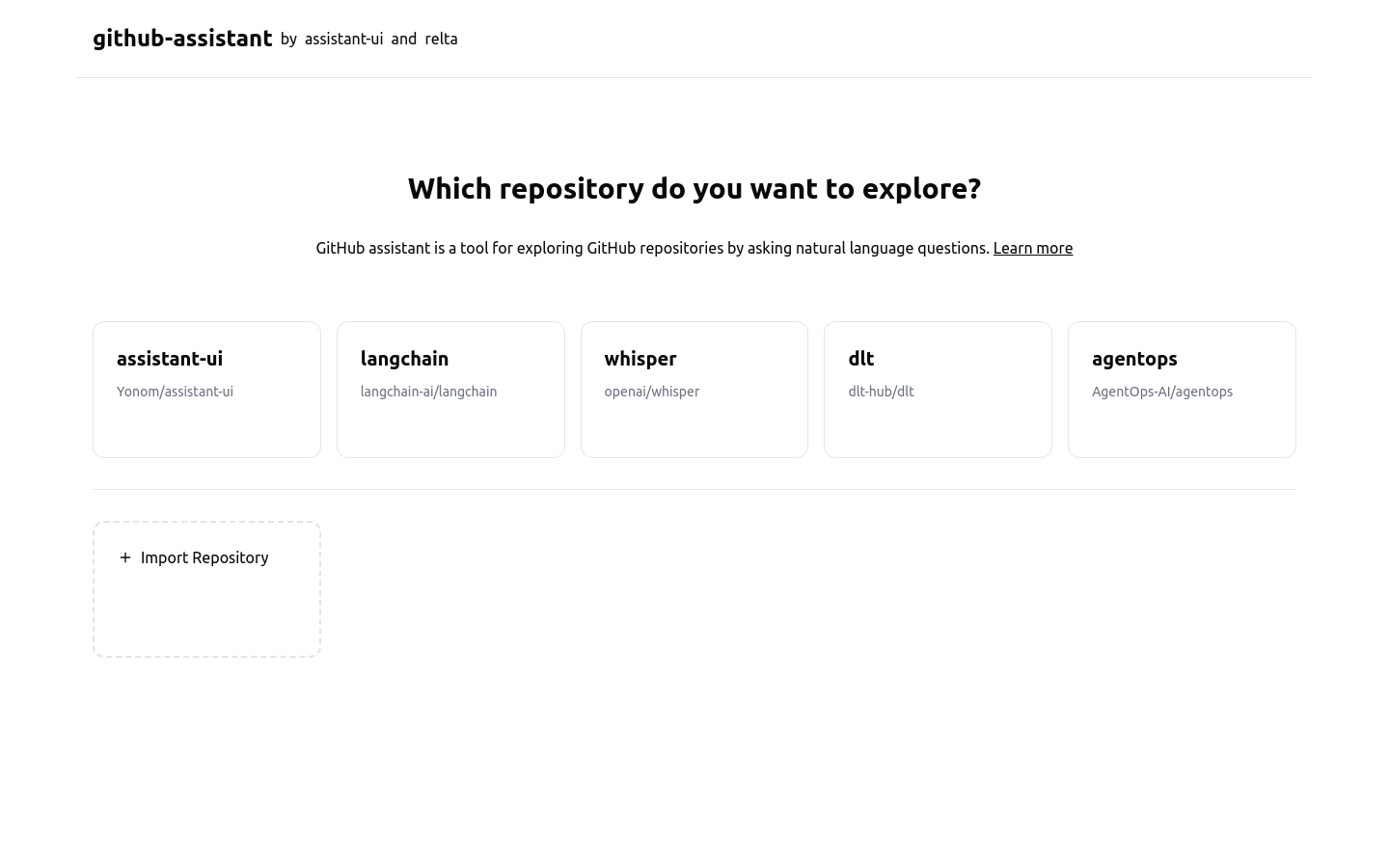

github-assistantGitHub Assistant 是一款创新的编程辅助工具,它利用自然语言处理技术,使用户能够通过简单的语言问题来探索和理解GitHub上的各种代码仓...

github-assistantGitHub Assistant 是一款创新的编程辅助工具,它利用自然语言处理技术,使用户能够通过简单的语言问题来探索和理解GitHub上的各种代码仓... -

MakeasiteMakeasite是一个在线平台,允许用户通过简单的提示快速生成和分享网站。它提供了一个直观的界面和多种模板,使得即使是没有编程背景的用户也能轻松创建...

MakeasiteMakeasite是一个在线平台,允许用户通过简单的提示快速生成和分享网站。它提供了一个直观的界面和多种模板,使得即使是没有编程背景的用户也能轻松创建... -

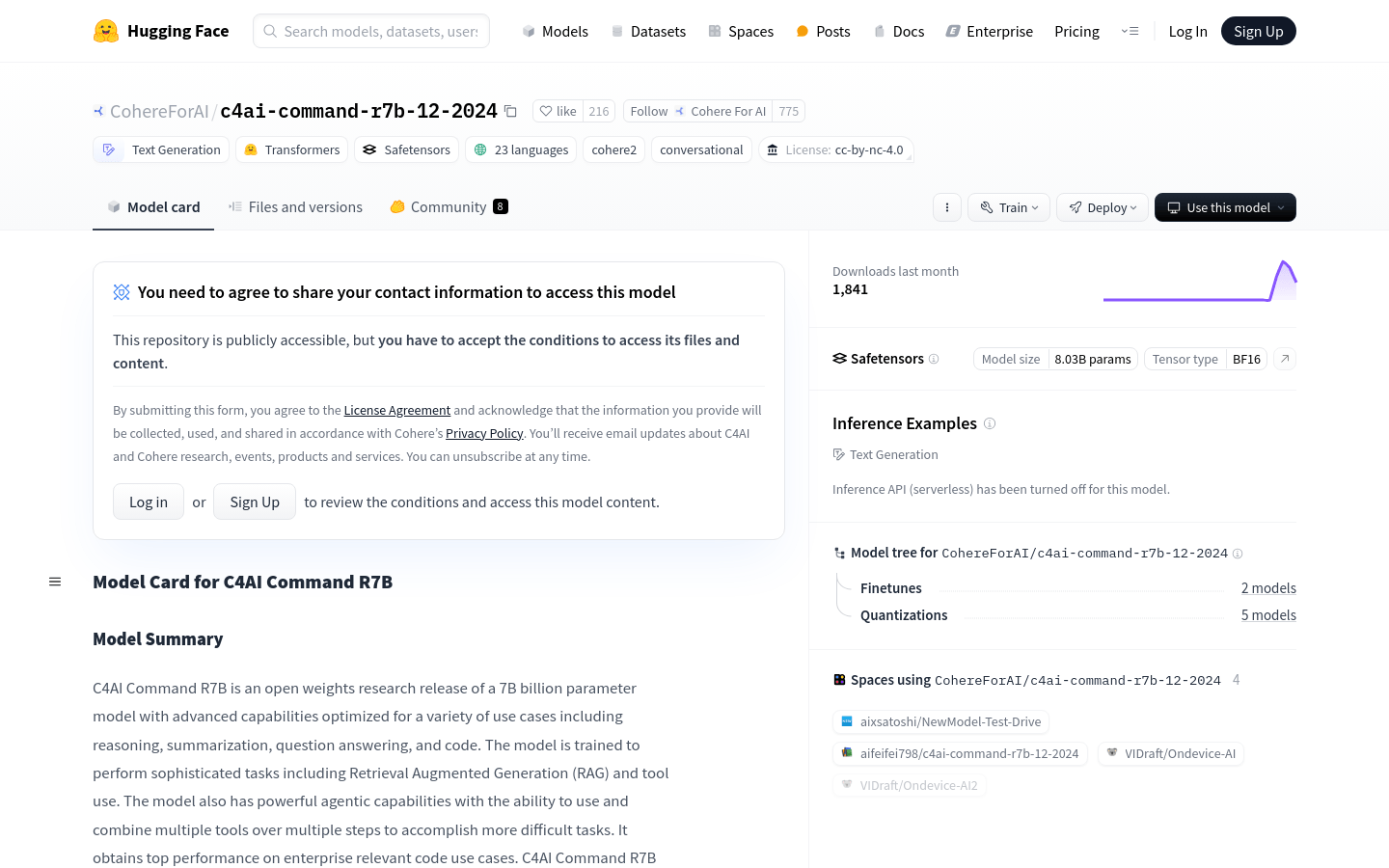

c4ai-command-r7b-12-2024CohereForAI/c4ai-command-r7b-12-2024是一个7B参数的多语言模型,专注于推理、总结、问答和代码生成等高级任务。该模型...

c4ai-command-r7b-12-2024CohereForAI/c4ai-command-r7b-12-2024是一个7B参数的多语言模型,专注于推理、总结、问答和代码生成等高级任务。该模型... -

UniDeckUniDeck是一个无代码仪表板平台,旨在简化技术使用,让用户能够轻松连接日常使用的工具并创建个性化的仪表板。它集成了流行的工具,如Jira、Goog...

UniDeckUniDeck是一个无代码仪表板平台,旨在简化技术使用,让用户能够轻松连接日常使用的工具并创建个性化的仪表板。它集成了流行的工具,如Jira、Goog... -

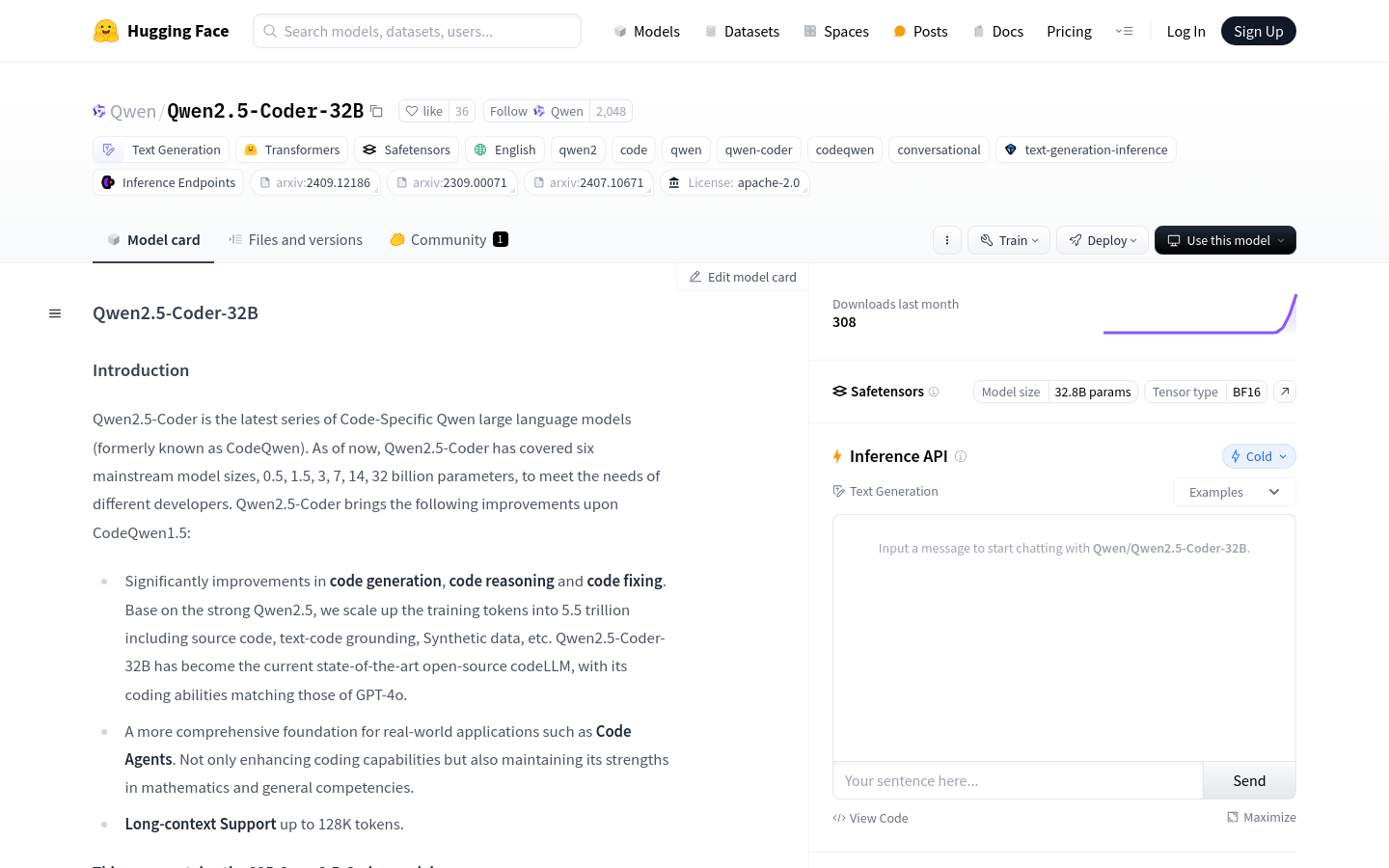

Qwen2.5-Coder Technical ReportQwen2.5-Coder系列是基于Qwen2.5架构的代码特定模型,包括Qwen2.5-Coder-1.5B和Qwen2.5-Coder-7B两个模...

Qwen2.5-Coder Technical ReportQwen2.5-Coder系列是基于Qwen2.5架构的代码特定模型,包括Qwen2.5-Coder-1.5B和Qwen2.5-Coder-7B两个模... -

GitHub Copilot Agent模式GitHub Copilot Agent模式是GitHub Copilot的一项重大升级,它通过引入自主智能体(Agent)技术,使开发者能够更高效地...

GitHub Copilot Agent模式GitHub Copilot Agent模式是GitHub Copilot的一项重大升级,它通过引入自主智能体(Agent)技术,使开发者能够更高效地... -

Veggie AIVeggie AI是一个在线工具,利用人工智能技术生成可控视频。用户可以输入图片、视频或文本提示,创建与提供的动作和角色描述完美匹配的短视频。它用户友...

Veggie AIVeggie AI是一个在线工具,利用人工智能技术生成可控视频。用户可以输入图片、视频或文本提示,创建与提供的动作和角色描述完美匹配的短视频。它用户友...

卓商AI

AI爱好者的一站式人工智能AI工具箱,累计收录全球10,000⁺好用的AI工具软件和网站,方便您更便捷的探索前沿的AI技术。本站持续更新好的AI应用,力争做全球排名前三的AI网址导航网站,欢迎您成为我们的一员。

最新收录

Spoke

Spoke是一款AI插件,为产品经理提供强大的、注重隐私的AI功能,能够在几秒钟内为用户提供上下文信息。它可以帮助全球快速增长的团队节省时间,创造上下...

LastMile AI

LastMile AI是一个AI开发平台,专为工程师而设计,可以用于原型开发和生成式AI应用的生产。它提供了一站式的多模态AI模型访问,包括语言模型(...

Dokkio

Dokkio是一款利用人工智能技术提供云文件协作的工具。它能帮助用户管理多个活动、搜索文档和文件、整理研究材料、组织内容库,并将所有文件和内容集中在一...

Engage Sphere AI

Engage Sphere是一个基于AI的员工参与度分析平台。它可以深入分析公司各个部门、团队和岗位的参与度,帮助管理者明确团队互动症结所在,并采取行...

Pikzels

Pikzels连接顶级人才和有远见的客户。我们促进协作,释放创意卓越。加入我们,获取来自各个领域的优秀专业人才。体验协作的力量,释放你的创意潜能。Pi...

Zoho Cliq

Zoho Cliq是一款专为提高企业工作效率而设计的在线即时通讯和协作平台。它将团队成员、对话和工作流集中在一个地方,实现无缝连接。主要功能包括:组织...

猜你喜欢

Boomy

Boomy 是一个能够帮助用户在几秒钟内创作原创歌曲的 AI 音乐创作工具。它可以生成各种风格的音乐,即使用户没有音乐创作经验也能轻松使用。用户可以将...

Audio Transcription

Audio Transcription是一款利用AI技术将音频内容转换为文本的在线工具。它能够帮助用户快速准确地将播客、音频文件或网址中的音频内容转写...

Superflex

Superflex是一款前端开发助理插件,旨在帮助开发者通过各种输入方式快速构建UI组件和页面。它支持从Figma设计、草图、截图或文本提示生成代码,...

zbrain

Zbrain使得在几分钟内启动定制的ChatGpt应用程序变得容易。导入的数据(包括任何源的文本或图像)迅速转换为GPT-4,FLAN或GPT-NEO...

M2UGen

M2UGen是一个结合大语言模型的多模态音乐理解和生成框架,旨在帮助用户进行音乐创作。它能同时完成音乐理解和多模态音乐生成任务。...

Noet

Noet是一个AI驱动的客户支持平台,旨在通过智能化、个性化的支持服务,彻底改变传统的客户体验。它利用先进的AI技术,实现24/7的智能语音和聊天支持...

最新文章

1

2

3

4

5

6

7

8

9

10